抓取亚马逊商品标题描述到底有什么用?

结论:抓取亚马逊商品标题描述的本质,是把“竞争对手已经验证过的表达方式”和“类目用户真正会读的关键信息”转成可计算的数据资产,用于Listing优化、竞品监控、广告创意迭代与规模化内容生产。

如果你只把标题和描述当作“写文案”,你会一直停留在靠经验撞运气的阶段;而当你能批量抓取同类目Top商品的标题结构、关键词分布、卖点表达、规格信息呈现方式,再把这些内容和排名、价格、评论等信号关联起来,你会更接近一种可复制的运营方法:先用数据找规律,再用规律改文案,然后用结果继续校正。

更现实的一点是,亚马逊运营已经越来越像一场信息战。标题与描述是买家决策链路的“第一语言”,也是平台相关性判断的重要信号之一。你不需要每天抓所有字段,但你必须能在关键节点抓到标题与描述:新品上架前的类目对标、竞品突然涨跌后的信息变更追踪、广告转化异常时的文案对照、以及多站点扩张时的本地化校验。

为什么“抓取标题描述”能直接影响Listing优化效果?

Listing优化不是“把关键词塞满”,而是把买家在意的信息用平台可理解的方式表达出来。标题与描述是最容易被运营团队主动控制的文本字段,也是最容易在竞品之间形成差异化的地方。你抓取到的不是文字本身,而是一个类目里“有效表达”的集合。

1)关键词覆盖与相关性:从“词表”走向“语义块”

很多团队做关键词研究,习惯先拉出一个词表,然后往标题和五点里硬塞,结果读起来像机器人写的,转化率还掉。更好的做法是把竞品标题和描述拆成可复用的语义块:材质与工艺、尺寸与兼容、使用场景、差异化卖点、风险消除(无异味、不过敏、易清洁)等。抓取的价值在于,你能看到这些语义块在类目Top商品里出现的频率、出现的位置和组合方式,从而把“关键词”升级为“能转化的表达结构”。

2)合规与类目规则:标题长度、敏感词与声明边界

不同类目、不同站点对标题写法的容忍度并不一致。有的类目对功效性词汇更敏感,有的类目对品牌词、认证标识、医疗声明有严格限制。你通过抓取竞品文案,可以更快建立“合规边界样本库”:哪些词在头部商品中普遍存在、哪些词基本不出现、哪些词只在特定站点出现。它比读规则更直观,也更贴近实际的审核尺度。

3)竞品监控:文案变更往往早于价格变更

很多卖家只监控价格和BSR,但文案的变更通常意味着对手在做新的测试:改标题结构、换核心卖点、调整人群定位、更新规格信息、突出新品升级点。我们在多个类目的监控中发现,头部竞品的标题/五点变更频率常常高于你想象,尤其在旺季前、促销期、以及差评集中出现后的修复期。持续抓取标题与描述,能让你更早发现对手的策略变化,从而更快做出回应。

4)规模化内容生产:广告、A+、站外落地页的素材池

当你做多ASIN、多个站点时,文案生产会成为瓶颈。抓取标题与描述能建立一个“可训练的素材池”:你可以抽取常见卖点句式、场景词、规格表达,做成模板与变量,再结合你自家的差异化信息生成更一致的品牌文案。对广告团队来说,标题与描述也能反哺创意:把竞品常见承诺点、痛点词和反对意见整理出来,直接用于广告文案测试与否定关键词筛查。

抓取亚马逊商品标题描述难在哪些地方?

“能抓到一次”不难,“能长期、稳定、可规模化地抓到一致的数据”才难。标题与描述看似是静态文本,但它们往往嵌在一个高度动态、强反爬、强个性化的页面系统里。

难点一:同一ASIN的页面会因环境不同而变化

同一个ASIN,在不同站点(US/UK/DE)、不同语言、不同邮编、不同Prime状态、不同设备、不同登录状态下,标题与描述可能会发生差异。更麻烦的是,亚马逊经常做A/B实验:你的抓取任务如果不固定环境参数,就会把多种版本混在同一个字段里,导致后续分析出现“假波动”。因此,大批量采集要把“上下文”当作数据字段的一部分:站点、邮编、货币、时间戳、是否渲染、是否命中验证码、变体选择等都要记录。

难点二:动态加载与模块化结构让解析变得脆弱

标题通常在HTML里相对稳定,但描述、五点、A+内容、以及不同类目的属性块可能通过脚本加载或被模块化拼装。页面结构一变,你的CSS选择器就会失效;而如果你依赖完整浏览器渲染,成本与并发又会飙升。一个可用的采集体系必须同时具备两种能力:在可静态解析时尽量静态化以降本,在必须渲染时能稳定渲染并提取关键模块。

难点三:反爬与风控决定“能不能跑得久”

大规模抓取的失败原因通常不是“代码写错”,而是被风控系统识别。常见触发点包括:请求频率异常、IP质量差、指纹一致性不佳、访问路径不自然、以及短时间内大量访问同一类目的相似页面。自建系统往往在一开始能跑,但一到规模阶段就进入“修修补补”的无底洞:代理、验证码、重试、降速、换指纹、排队调度,每个环节都在消耗工程资源。

难点四:合规边界与数据使用目的需要提前设计

公开页面数据并不等于可以无限制自动化抓取。合规实践通常围绕三个关键词:最小必要、合理频率、明确用途。你需要在项目设计阶段就决定:哪些字段必须抓,抓取频率是分钟级还是日级,是否需要缓存与增量,数据用在内部分析还是提供给外部客户。越早把这些边界写清楚,越能减少后期返工与风险。

自建爬虫、SP-API、第三方Scrape API:怎么选?

方案选择没有绝对正确,只有是否匹配你的目标:你是做单次研究,还是做长期监控?你需要几十个ASIN,还是需要几十万?你更在意成本还是稳定?下面用“能拿到什么、需要付出什么、会卡在哪里”三条线把三类方案讲清楚。

方案一:手工/浏览器插件(适合小规模、低频)

优点是几乎零技术门槛,适合选品时临时对比十几个ASIN;缺点也明显:无法规模化、无法复现、无法审计。更重要的是,你很难把手工复制的标题描述与时间戳、邮编环境、变体状态等上下文绑定,后续分析价值有限。

方案二:自建爬虫(适合有工程团队、需求高度定制)

自建的最大优势是可控与可定制,尤其当你需要抓取非常小众的模块或做深度页面行为模拟时;但它的长期成本经常被低估。为了跑得久,你最终会实现一整套体系:代理池、浏览器渲染集群、指纹管理、验证码处理、任务队列、失败重试、解析模板、质量监控、告警与回滚。任何一个模块弱,都可能导致数据质量崩掉。

如果你的目标是“把标题描述当作业务数据持续使用”,自建真正的成本不是开发一次,而是持续维护与应对变化。对于多数卖家团队而言,这部分成本会逐步吃掉你本该投入到运营与增长的精力。

方案三:SP-API(适合授权数据、不是竞品研究的主路径)

SP-API在合规层面更清晰,但它天然更偏向“你有授权的账户与商品”。即便Catalog接口能返回标题等属性,也存在覆盖不全、延迟、以及字段与前台展示不一致的问题;更关键的是,竞品研究通常无法通过SP-API直接获取对手的完整前台文案模块。因此,把SP-API当作“自家商品的数据源”,把页面级采集当作“市场与竞品的观察窗口”,往往更符合实际。

方案四:专业Scrape API(适合长期、规模化、追求稳定)

专业Scrape API把难度最高的部分封装掉:反爬对抗、渲染与解析模板维护、并发与稳定性治理。你拿到的是结构化字段或可解析的HTML,再在自己侧做业务逻辑:任务调度、增量更新、数据质检、与运营系统/BI的融合。对于要做“持续监控 + 批量”的团队,这是最接近ROI最优的路径。

当前最好的方案是什么?为什么它通常是“API + 任务系统”的组合?

如果你需要持续抓取亚马逊商品标题描述,并且数据要进入运营流程(词库、监控、报表、告警、内容生产),最稳妥的方案通常是:用企业级Scrape API解决“获取与解析”,再用你自己的任务系统解决“规模与业务”。这不是“把技术外包”,而是把最不值得重复造轮子的部分交给专业团队,把你最有差异化的部分留在自己手里。

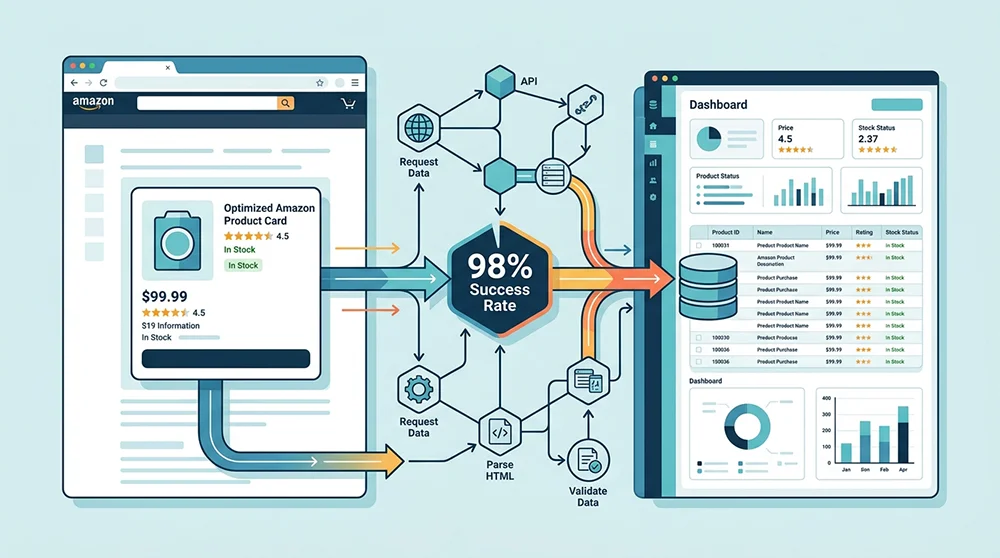

以Pangolinfo Scrape API为例,你可以把“抓取亚马逊商品标题描述”定义成一个标准任务:输入ASIN与站点、邮编等参数,输出结构化字段(标题、五点、描述、A+摘要、品牌、类目、变体维度等)。当这些字段稳定可得,你才能真正做运营层的自动化:自动发现竞品标题结构变化、自动对比关键词覆盖、自动生成改写候选、自动推送给内容同学审核。

如果你在做Agent或内部工具,进一步可以用Pangolinfo Amazon Scraper Skill把采集能力变成“可调用的工具”,让分析与内容生成流程更连贯:先抓取竞品标题描述,再让模型总结结构与差异点,再生成你的改写版本与实验建议。

如何做大批量抓取:一套能跑得久的架构长什么样?

大批量抓取的关键指标从来不是“每秒多少请求”,而是“连续运行30天后数据仍然可用”。一个可持续的系统需要把采集当成一条数据生产线:输入规范、产出稳定、质量可验、失败可追、成本可控。

第一步:把抓取任务标准化(输入、输出与上下文)

建议把每次抓取都定义成同一种可复现的任务,至少包括:ASIN/URL、站点、语言、邮编、是否渲染、变体选择策略、以及抓取时间戳。输出则明确字段定义:标题、五点、描述、A+摘要、品牌、类目、变体矩阵等,同时保留原始HTML或关键片段以便回溯。

第二步:用队列做并发,用策略做增量

批量抓取最大的浪费来自“重复抓取没变化的页面”。更合理的方式是用增量策略:高波动类目与头部竞品高频抓,长尾低频抓;标题/描述变更触发二次抓取;出现排名或转化异常时提高频率。你会发现,真正需要高频抓取的商品可能只占总量的10%–20%,而这部分才是你运营决策最依赖的数据。

第三步:数据质检要像财务对账一样严格

在规模化场景里,“偶尔错一次”会变成“每天错一万次”。建议至少做四类质检:字段完整率(标题是否为空)、结构一致性(五点是否异常合并)、异常波动检测(标题长度突然骤减)、以及样本抽检回看(随机抽取原始页面核对)。当你把质检做成仪表板和告警,你才真正拥有了一个可运营的数据系统。

第四步:把采集结果接进运营闭环

抓取不是终点。你可以把标题与描述的结构化字段接入词库系统、竞品监控看板、以及内容生产流程:例如每天输出“本类目标题结构变化Top 20”、每周输出“新增高频场景词与风险消除词”、并把可落地的改写建议推送到协作工具里。对于需要更完整的商品信息字段(价格、库存、评论等),可以组合使用Scrape API与Reviews Scraper API,让“文案”与“市场反馈”在同一个数据视图里对齐。

一个可运行的最小技术示例(示意)

下面示意如何把任务标准化并写入队列,然后异步拉取结果。真实生产环境还应加入签名、重试、幂等、限流与日志治理。

import json

import time

from urllib.request import Request, urlopen

API_URL = "https://api.example.com/amazon/scrape"

API_KEY = "YOUR_API_KEY"

def scrape_title_description(asin: str, marketplace: str, zipcode: str):

payload = {

"asin": asin,

"marketplace": marketplace,

"zipcode": zipcode,

"fields": ["title", "bullets", "description", "a_plus"],

"render": True

}

req = Request(

API_URL,

data=json.dumps(payload).encode("utf-8"),

headers={

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

},

method="POST"

)

with urlopen(req, timeout=60) as resp:

return json.loads(resp.read().decode("utf-8"))

if __name__ == "__main__":

result = scrape_title_description("B0XXXXXXX", "amazon.com", "10001")

print(result.get("title"))

time.sleep(1)这段代码的重点不是语法,而是“输入要包含上下文、输出要结构化”。当你把这一点落地,后续才能做批量调度与质量控制。

总结:把标题描述从“文案”变成“可复用的数据资产”

抓取亚马逊商品标题描述的价值,最终会体现在三个指标上:你能更快找到类目里有效表达的规律,你能更早发现竞品策略变化,你能更低成本地把内容生产规模化。难点也很明确:环境一致性、动态渲染、反爬风控、解析维护与合规边界。只要你的目标不是“抓一次”,而是“长期抓、批量抓、抓了能用”,就需要把采集当作系统工程来做。

如果你希望把采集能力快速接入运营流程,可以从Pangolinfo Scrape API开始,先跑通“ASIN列表 → 结构化标题描述 → 竞品对比与改写建议”的最小闭环;当你需要让分析与内容生产更自动化,再考虑用Amazon Scraper Skill把采集能力交给Agent调用。

FAQ:关于抓取亚马逊商品标题描述的常见问题

抓取亚马逊商品标题描述主要用于哪些运营场景?

用于Listing优化、竞品监控、关键词覆盖分析、广告创意与站外内容素材建设,尤其适合多ASIN与多站点运营团队。

为什么同一ASIN抓到的标题描述会不一致?

受站点、语言、邮编、Prime状态、设备与A/B实验影响。批量采集要固定环境参数并记录上下文与时间戳。

SP-API能不能拿到竞品标题和描述?

SP-API更偏授权与自家数据。竞品文案模块通常需要页面级采集或第三方Scrape API辅助。

大批量抓取亚马逊标题描述最难的点是什么?

长期稳定与质量控制:反爬、模板变化、动态渲染、并发成本、解析容错、增量更新与合规风控。

当前最好的方案是什么?

对多数团队而言,企业级Scrape API负责获取与解析,你的任务系统负责调度、增量与质检,是最稳的组合。查看 API文档