现在就给你的 OpenClaw 装上手脚:访问 Pangolinfo Scrape API,前往 Pangolinfo 控制台 获取 API Key,今天就完成数据接入。

你以为部署了 OpenClaw,就拥有了 AI Agent?

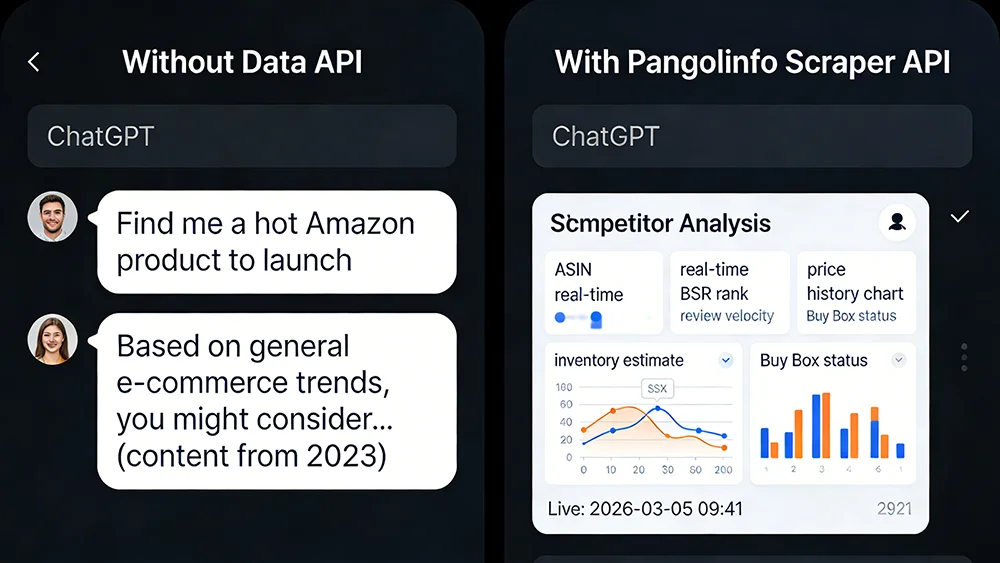

来,我们做个小测试。打开你辛苦部署好的 OpenClaw,输入这条指令:“帮我分析一下亚马逊上蓝牙耳机的市场现状,找出竞争最小的细分品类,给我一个选品建议。”

你会得到什么?大概率是一段逻辑严密、条理清晰、引经据典的长篇回答。看起来很专业。但仔细一读:数据截止于 2023 年,没有实时 BSR 排名,没有当前竞争格局,没有最新上架的爆款对比……这不是在帮你选品,这是在帮你生产一篇措辞体面的废话。

这不是你的 OpenClaw 配置问题。这是很多人忽视的关键盲区:不完成 OpenClaw 接入数据 API 这一步,你的 AI Agent 本质上和打开 ChatGPT 聊天窗口没有区别。一个是跑在你服务器上的 ChatGPT,一个是跑在 OpenAI 服务器上的 ChatGPT。你多花了服务器费,没多得到任何东西。

这篇文章不是来教你”如何配置 OpenClaw”的。网上那类教程已经够多了。这篇文章要做的,是先戳破幻想,再给你一条真正能让 Agent 干活的路。

大模型的本质:超级逻辑引擎,而非信息源

理解这个问题需要先搞清楚一个基本事实:大语言模型(LLM)不是百科全书,它是逻辑引擎。

GPT-4、Claude、Gemini——这些模型的核心能力是推理、归纳、生成结构化文本。它们确实”知道”很多东西,但这些知识都来自训练数据,都有截止日期。一旦涉及到”现在怎样?””今天的价格是多少?””本周 BSR 排名第一的是谁?”——模型会进入它最擅长的一种模式:用逻辑编造符合常识的答案。

这不是 bug,这是特性。问题在于,电商运营恰恰是一个极度依赖实时数据(Real-time Data)的场景:

- 选品需要今天的 BSR 趋势、过去 30 天的评论增速、近期上架的竞品

- 定价需要当前竞品价格、Buy Box 归属、历史价格波动

- 运营决策需要实时库存状态、Deal/优惠券活动、流量来源变化

这三类数据,LLM 一条都给不出来。它能给你的,是把你的问题按照逻辑框架重新包装一遍,然后用 2023 年之前的”大致规律”回答你。一般情况下听起来很对,用来做实际决策大概率要吃亏。

没有数据接入,你的 OpenClaw 能干什么?(诚实清单)

| 任务类型 | 无数据 API(套壳 ChatGPT) | 接入 Pangolinfo 数据 API |

|---|---|---|

| 亚马逊新品选品 | ❌ 只能给趋势泛谈,数据截至训练集 | ✅ 实时 BSR、评论速率、竞品利润估算 |

| 竞品价格监控 | ❌ 无法知道当前价格 | ✅ 实时抓取多 ASIN 价格,触发预警 |

| Buy Box 分析 | ❌ 不知道现在谁持有 Buy Box | ✅ 实时获取 Buy Box 卖家信息 |

| Listing 优化建议 | ⚠️ 可以,但只基于静态最佳实践 | ✅ 基于竞品当前 Listing 内容对比 |

| 撰写邮件/回复模板 | ✅ 真正擅长,不需要实时数据 | ✅ 同上(数据接入对这类任务影响不大) |

看清楚了吗?凡是需要”现在”信息的任务,不完成 OpenClaw 接入数据 API,全部失效。只有那些纯粹文字生成的任务——写邮件、改 Listing 文案风格、做用户问题分类——才是不接数据也能用的场景。

如果你部署 OpenClaw 只是为了写邮件,那你确实不需要读这篇文章。但如果你想让它帮你做电商运营决策,继续读。

为什么 OpenClaw 默认”看不见”外面的世界?

不是 OpenClaw 设计有问题。问题在于搭建真正可用的数据采集能力,本身就有相当的技术门槛。

要让 Agent 实时抓取亚马逊数据,你需要:

- 无头浏览器(Headless Browser):亚马逊的动态内容需要 JavaScript 渲染才能完整加载,静态 HTTP 请求拿不到完整页面

- 住宅代理 IP 池(Residential Proxy Pool):亚马逊针对数据中心 IP 有强力封禁机制,用普通的服务器 IP 请求会被秒封

- 反检测机制:浏览器指纹轮换、请求频率控制、Cookie 管理……这些都需要持续维护

- 数据解析层:从 HTML 中准确提取 ASIN、价格、排名、评论数,并处理页面结构变化带来的解析失效

建这套东西,少则两到三周,长则持续维护。而且亚马逊页面每隔一段时间就会改版,你的解析脚本随时面临失效风险。这就是为什么大多数 OpenClaw 用户的 Agent 是”高位截瘫的天才”——大脑(LLM)完全没问题,但没有手脚(数据工具),它只能空转。

真正的 Agent 公式:大脑 + 手脚

-Pangolinfo-API(手脚).webp)

学术界对 Agent 的定义是:能感知环境、做出决策并执行行动的智能实体。关键词是”感知环境”——LLM 本身没有感知能力,它只有处理已有信息的能力。让它感知真实世界,需要工具(Tools)。

Pangolinfo 扮演的角色,就是 OpenClaw 的”外骨骼”——它不替换 LLM 的逻辑能力,而是给它装上感知外部世界的手脚。通过 Pangolinfo Scrape API,你的 OpenClaw Agent 可以:

- 实时抓取任意亚马逊 ASIN 的完整商品数据(价格、BSR、评论、库存、Buy Box 状态)

- 批量监控竞品列表,触发价格异动预警

- 获取搜索结果页(SERP)排名数据,分析关键词竞争格局

- 抓取商品评论,为 Agent 的选品和 Listing 优化提供真实用户反馈

Agent 时代:接入门槛已大幅降低

这里有个好消息。你甚至不需要自己研究 API 文档、手动写集成代码——在 Agent 时代,你可以让 OpenClaw 帮你完成接入本身。

操作极其简单:把 Pangolinfo API 文档 的链接和你的 API Key 发给 OpenClaw,告诉它目标是”接入亚马逊数据采集能力”——它会自动读取文档、理解接口规范、构造正确的请求格式,完成与 Pangolinfo Amazon Scraper API 的全自动对接。

你只需要准备两样东西:

- 📄 Pangolinfo 文档:docs.pangolinfo.com

- 🔑 API Key:在 Pangolinfo 控制台 免费获取

这才是 Agent 时代的正确打开方式:用 AI 配置 AI,把工程师从重复的 API 集成工作中解放出来。当然,如果你希望对接入过程有完整掌控,下面也提供了完整的手动集成代码。

数据以结构化 JSON 返回,LLM 可以直接消费,无需你再写解析脚本。整个基础设施——代理池、反检测、渲染——全部在 Pangolinfo 服务端完成,你只需要发出 API 请求。

核心 API 参数速查

POST https://scrapeapi.pangolinfo.com/api/v1/scrape

Headers:

Content-Type: application/json

Authorization: Bearer {YOUR_API_KEY}

Body(亚马逊商品页示例):

{

"url": "https://www.amazon.com/dp/{ASIN}",

"parserName": "amazonProduct", // 使用亚马逊商品专用解析器

"country": "us" // 指定亚马逊站点

}响应包含价格、评分、评论数、BSR、Buy Box 状态、库存、卖家信息等全量结构化字段,可直接传入 OpenClaw Agent 的上下文窗口。

从”瞎聊”到”秒出报告”:完整的 OpenClaw 接入数据 API 实战

下面是一个可以直接用于 OpenClaw 的 Python 工具函数,把 Pangolinfo Amazon Scraper API 封装成 Agent 可调用的 Tool:

import requests

import json

from typing import Optional

class PangolinAmazonTool:

"""

OpenClaw 数据工具:Pangolinfo Amazon Scraper API 封装

为 Agent 提供实时亚马逊商品数据

"""

BASE_URL = "https://scrapeapi.pangolinfo.com/api/v1/scrape"

def __init__(self, api_key: str):

self.headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {api_key}"

}

def get_product(self, asin: str, country: str = "us") -> dict:

"""

获取单个 ASIN 的实时商品数据

Args:

asin: 亚马逊商品编号(如 B09G9FPHY6)

country: 站点代码(us / uk / de / jp 等)

Returns:

包含价格、BSR、评分、Buy Box 等字段的结构化数据

"""

url = f"https://www.amazon.{country}/dp/{asin}"

payload = {

"url": url,

"parserName": "amazonProduct",

"country": country

}

resp = requests.post(

self.BASE_URL,

headers=self.headers,

json=payload,

timeout=30

)

resp.raise_for_status()

result = resp.json()

if result.get("code") != 0:

raise ValueError(f"API 错误: {result.get('message')}")

return self._extract_key_fields(result["data"])

def compare_competitors(

self,

asins: list[str],

country: str = "us"

) -> list[dict]:

"""

批量对比竞品数据

Args:

asins: ASIN 列表(建议 ≤10 个)

country: 站点代码

Returns:

按 BSR 排序的竞品数据列表

"""

results = []

for asin in asins:

try:

data = self.get_product(asin, country)

data["asin"] = asin

results.append(data)

except Exception as e:

results.append({"asin": asin, "error": str(e)})

# 按 BSR 升序排列(排名越小越靠前)

return sorted(

[r for r in results if "bsr" in r],

key=lambda x: x.get("bsr", 9999999)

)

def _extract_key_fields(self, data: dict) -> dict:

"""提取 Agent 最常使用的核心字段"""

return {

"title": data.get("title", ""),

"price": data.get("price", {}).get("current"),

"rating": data.get("rating"),

"review_count": data.get("reviewCount"),

"bsr": data.get("bestSellersRank", [{}])[0].get("rank"),

"bsr_category": data.get("bestSellersRank", [{}])[0].get("category"),

"buy_box_winner": data.get("buyBox", {}).get("seller"),

"in_stock": data.get("availability") == "In Stock",

"seller_count": data.get("offerCount"),

"scraped_at": data.get("scrapedAt")

}

# ==================== OpenClaw Tool 注册示例 ====================

# 初始化工具

amazon_tool = PangolinAmazonTool(api_key="YOUR_PANGOLINFO_API_KEY")

# 示例:让 OpenClaw Agent 调用竞品对比

competitor_asins = ["B09G9FPHY6", "B0BTSR8T9M", "B0CKQSQ2WS"]

report = amazon_tool.compare_competitors(competitor_asins, country="us")

# OpenClaw Agent 接收到的上下文(JSON 格式,LLM 可直接分析)

for item in report:

print(f"ASIN: {item['asin']}")

print(f" 价格: ${item.get('price', 'N/A')}")

print(f" BSR: #{item.get('bsr', 'N/A')} in {item.get('bsr_category', '')}")

print(f" 评分: {item.get('rating')} ({item.get('review_count')} reviews)")

print(f" Buy Box: {item.get('buy_box_winner', '未知')}")

print(f" 数据时间: {item.get('scraped_at')}")

print()

将这个工具函数注册到 OpenClaw 的 Tool Router 后,你的 Agent 就可以直接响应”帮我分析这几个竞品”的请求——它会自动调用 Pangolinfo API 拿回实时数据,然后用 LLM 的逻辑能力分析、归纳、生成结构化的竞品分析报告。这才是真正的 OpenClaw 接入数据 API之后应该有的效果。

被接入后,OpenClaw 能做什么?

一个完成数据接入的 OpenClaw,面对同样的问题”帮我找蓝牙耳机类目的新品机会”,给出的不再是模糊的趋势描述,而是:

- 当前 BSR TOP 20 的 ASIN 列表及各自的评论数/评分

- 过去 30 天内新上架(评论数 < 50)但已进入 BSR 前 100 的”黑马品”

- 各价格区间的竞争密度(卖家数量)

- Buy Box 集中度(是否有一家主导)

- 基于以上数据,LLM 自动生成的选品建议和差异化方向

数据来自 Pangolinfo 的实时采集,分析来自 LLM 的推理。这才是正确的分工,也是真正意义上的 AI Agent。

别让服务器只跑一个聊天框

你在服务器上部署 OpenClaw,花了时间,花了钱,最终运行的如果只是个”换皮 ChatGPT”,那这笔投资的回报率趋近于零。

不是 OpenClaw 不好,是少了关键的一块拼图:实时数据接入。大模型是大脑,但大脑需要眼睛、耳朵、手脚。对于电商运营场景,Pangolinfo Scrape API 就是那套感知系统——住宅代理池、无头浏览器、结构化解析,全部封装好,你只需要一个 POST 请求。

完成 OpenClaw 接入数据 API 这一步,你的 Agent 才真正从聊天框进化成电商智能体:能实时感知市场、能对比竞品数据、能触发价格预警、能生成有价值的分析报告。配置好之后,让 AI 真正干活。

前往 Pangolinfo Scrape API 产品页 了解详情,访问 API 文档 查看完整的解析器列表,或直接在 控制台 获取 API Key,今天就完成接入。