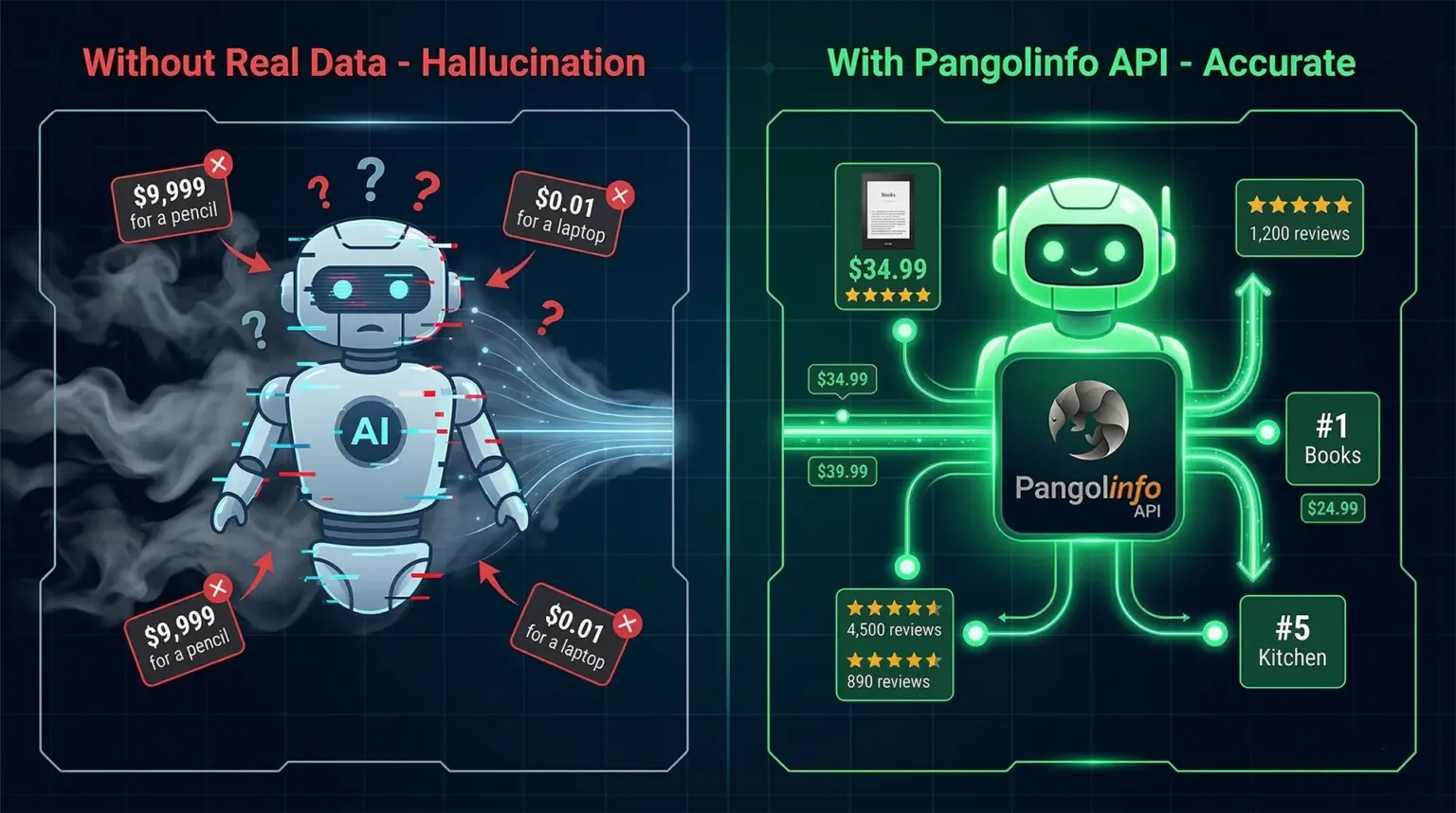

你的 AI 助理在电商场景说谎,而它完全不知道自己在说谎

一位做跨境电商的朋友最近跟我说了一件令他哭笑不得的事:他花了两周时间搭建了一套 AI 选品助手,基于 Open Claw 框架,接入了 GPT-4o,结果第一次让它分析竞品时,AI 信心满满地告诉他,目标 ASIN 的当前售价是 $34.99,BSR 排名在类目前 200,评价数量 1,873 条,综合评分 4.3 星。数据说得头头是道,有理有据,格式也漂亮。

问题是,那个产品早在 2024 年底就已经下架了。

这就是大模型在电商场景最典型的幻觉表现:它不是因为”不懂”才出错,恰恰相反,它太”懂”了,懂到会从训练数据里拼凑出一个听起来完全可信的假答案。价格、排名、评价数量,每个字段都有,每个数字都合理,每一条都是编的。更危险的是,它在编造时毫无犹豫,语气和给出真实数据时一模一样。

对于亚马逊选品、竞品监控、动态定价、库存预警这些电商核心场景而言,这种”一本正经的胡说八道”不是小问题,而是会直接影响决策、造成实际损失的系统性风险。Open Claw 接入实时亚马逊数据,正是解决这个问题的关键路径。

为什么大模型必然在实时数据上产生幻觉?这是架构问题,不是智力问题

先把根本原因说清楚,才能理解为什么接入实时数据是唯一有效的解法。

所有主流大语言模型——GPT-4o、Claude 3.5、Qwen、DeepSeek——都有一个不可回避的核心局限:训练数据截止日期(Knowledge Cutoff)。GPT-4o 的训练数据截止于 2024 年 4 月,这意味着它对亚马逊平台的认知永远停留在那个时间点之前。不管你现在用它问 2026 年 3 月某款产品的价格,它能给你的最好答案,也不过是从历史数据里外推猜测。

亚马逊的数据更新速度远超任何模型的训练周期。一个 ASIN 的价格可以在 15 分钟内波动 20%,BSR 榜单每隔 1-2 小时刷新一次,新增评论以分钟级速度累积,广告位排列每次页面刷新都可能不同。这种动态性使得任何静态训练的模型,在电商实时数据问题上,天生就是错的。

更棘手的是模型的”置信度错配”问题。大模型输出文本时没有内置的”我不确定”机制——它不会在说出一个推测值时自动加上误差范围。相反,它的目标是生成流畅、连贯的输出,这就导致它在缺乏真实数据时,会从训练数据里提取相近的模式,组合成一个”看起来像真实数据”的假答案,并且以和真实数据完全相同的确定性语气呈现出来。

行业内有人试图用 function calling、联网搜索来解决这个问题。这些方案确实方向正确,但在电商专业场景存在明显短板。联网搜索抓到的往往是亚马逊前端页面的缓存快照,而非原始结构化数据;function calling 如果背后调用的是爬虫能力不稳定的接口,反封率高、解析成功率参差不齐的问题会直接传导给大模型,让幻觉从”编造数据”变成”基于错误数据做出错误推理”,性质一样糟糕。

在大模型 AI Agent 对电商数据幻觉问题的解法上,关键不在于让模型”更聪明地猜”,而在于让模型”根本不需要猜”——在它需要回答实时数据问题之前,就把真实的、结构化的、有时间戳的亚马逊数据注入它的上下文窗口。这就是 RAG(检索增强生成)在电商场景的核心价值。

主流”解决方案”的实际效果对比

很多团队踩过同样的坑,值得把常见方案的优劣明确列出来,避免重复试错。

直接依赖模型记忆:幻觉率接近 100%,完全不可用于实时数据场景,甚至会倒退读者信任——一旦用户发现一条数据是假的,整个系统的可信度归零。联网搜索插件(如 ChatGPT 的 Web Browse):数据时效性取决于搜索引擎缓存,无法保证分钟级新鲜度,且无法返回结构化 JSON 供 Agent 处理,高频调用下成本不可控。自建爬虫直接访问亚马逊:开发周期长,反爬机制对抗成本持续上升,IP 封禁一旦触发则全线瘫痪,不适合生产环境的稳定运营。

相比之下,接入专业的亚马逊数据 API——比如 Pangolinfo Scrape API——将实时采集能力外包给专业服务商,让 AI Agent 只负责理解和推理,是目前性价比最高、工程复杂度最低的方案。

RAG 架构如何从根本上解决幻觉:给 Open Claw 接入实时数据的原理解释

在 Open Claw 框架下实现 RAG(检索增强生成)的逻辑其实并不复杂,但理解清楚其中的数据流动,对后面的接入实操非常重要。

标准的 Open Claw Agent 运行模式是:用户输入 Prompt → 大模型处理 → 输出结果。在这个链路里,大模型的”知识库”完全依赖训练参数,对实时世界一无所知。RAG 的介入改变了这个链路,在 Prompt 到达大模型之前,先触发一个数据检索步骤——查询亚马逊实时数据源,取回相关的结构化信息,将其作为上下文拼接进 Prompt,最后再递给大模型处理。

改变之后的链路变成:用户输入 → 识别数据需求 → 调用 Pangolinfo API 获取实时亚马逊数据 → 将数据结构化注入 Context → 大模型基于真实数据推理 → 输出可验证的结果。大模型不再需要”记住”亚马逊的数据,它只需要读懂我们喂给它的实时数据,并基于这些数据做推理。幻觉的诱因从根源上消除了。

这个方案之所以在工程层面可落地,有几个关键前提:一是 API 响应速度足够快(延迟过高会拖慢整个 Agent 响应链路);二是返回的数据格式标准化,直接可被大模型解析;三是 API 的稳定性和采集成功率足够高,否则 Agent 遭遇空数据时还是会退化到猜测模式。

这三点,正好是选择数据 API 服务商时最核心的评估维度——后面的实操部分会具体展开。

Pangolinfo Scrape API:专为 AI Agent 场景设计的亚马逊实时数据源

在为 Open Claw 选择数据源时,我们测试过市面上几家主流的亚马逊数据 API,最终在核心指标上选择了 Pangolinfo Scrape API。几个关键原因值得详细说明。

数据时效性方面,Pangolinfo 支持实时请求模式,每次 API 调用触发一次真实的页面采集,返回的是未经缓存的当前数据,时间戳精确到分钟级。对于亚马逊这种价格波动频繁的平台,这意味着 AI Agent 做决策时依赖的数据,和平台上真实显示的数据之间的误差窗口被压缩到了极限。

数据覆盖方面,Pangolinfo 支持亚马逊商品详情页(包含价格、库存状态、变体、A+ 内容)、热卖榜单(BSR 实时排行)、新品榜、关键词搜索结果页、商品评论(包含完整的 Customer Says 信息)、广告位数据(SP 广告位采集率达行业领先的 98%)。这些字段覆盖了电商 AI Agent 在选品、定价、竞品分析场景下的绝大多数数据需求。

输出格式方面,API 支持原始 HTML、Markdown 和结构化 JSON 三种格式。对于 AI Agent 的 RAG 接入场景,推荐使用结构化 JSON,key-value 对的形式可以直接被 Prompt 模板格式化引用,无需额外的解析步骤,降低了 Agent 开发的工程复杂度。

稳定性和规模方面,Pangolinfo 的基础设施支持千万级页面/天的采集体量,对于需要高频调用的 AI Agent 场景(例如监控数百个 ASIN 的价格变动),不存在限速瓶颈问题。同时,专业的反封禁机制处理了 IP 轮换、请求指纹伪装等底层工程细节,让 Agent 开发者可以专注在业务逻辑层,而不是陷在爬虫对抗的泥潭里。

如果你的场景还涉及用户评价的深度分析——比如让 AI Agent 自动提炼竞品差评高频词,或者分析某个类目的用户痛点——Reviews Scraper API 提供了更专门化的评论数据采集能力,支持按 ASIN、按星级、按时间段过滤,直接返回结构化的评论列表,可无缝拼接进 AI Agent 的分析 Prompt。

对于不想从零搭建 Agent 数据接入层的团队,Pangolinfo 的 AMZ Data Tracker 提供了可视化配置界面,支持无代码接入亚马逊数据监控,适合运营团队直接使用,不一定需要专职开发资源介入。

实战代码:在 Open Claw 中集成 Pangolinfo API 的完整实现

下面的代码演示了如何在 Open Claw 框架内实现一个带实时亚马逊数据接入的 RAG Agent。代码基于 Python,可直接运行,每一步都加了注释说明。

首先,安装依赖并配置 API 密钥。Pangolinfo API 的完整文档可以在 文档中心 查阅,控制台和免费试用入口在 tool.pangolinfo.com。

import requests

import json

from openai import OpenAI # 或其他大模型 SDK

# ──────────────────────────────────────────────

# Step 1:配置 Pangolinfo API 密钥

# ──────────────────────────────────────────────

PANGOLIN_API_KEY = "your_pangolinfo_api_key_here"

PANGOLIN_API_URL = "https://api.pangolinfo.com/v1/amazon/product"

# ──────────────────────────────────────────────

# Step 2:定义亚马逊数据检索函数

# 这是 RAG 的"检索"环节,负责从数据源拉取实时信息

# ──────────────────────────────────────────────

def fetch_amazon_product_data(asin: str, marketplace: str = "amazon.com") -> dict:

"""

通过 Pangolinfo Scrape API 获取亚马逊商品实时数据

返回结构化 JSON,包含价格、BSR、评价等关键字段

"""

headers = {

"Authorization": f"Bearer {PANGOLIN_API_KEY}",

"Content-Type": "application/json"

}

payload = {

"asin": asin,

"marketplace": marketplace,

"output_format": "json", # 指定 JSON 输出,方便 Prompt 拼接

"fields": ["price", "bsr", "rating", "review_count",

"availability", "title", "category"]

}

response = requests.post(PANGOLIN_API_URL, headers=headers, json=payload)

response.raise_for_status()

return response.json()

# ──────────────────────────────────────────────

# Step 3:构建 RAG Prompt

# 将实时数据注入 LLM 的上下文窗口,消除幻觉

# ──────────────────────────────────────────────

def build_rag_prompt(user_query: str, product_data: dict) -> str:

"""

将亚马逊实时数据拼接进 Prompt 模板

大模型将基于这些真实数据进行推理,而非从训练记忆中猜测

"""

data_context = f"""

【实时亚马逊商品数据 - 数据时间戳:{product_data.get('timestamp', 'N/A')}】

- 商品标题:{product_data.get('title', 'N/A')}

- 当前售价:{product_data.get('price', 'N/A')}

- BSR 排名:{product_data.get('bsr', 'N/A')}(类目:{product_data.get('category', 'N/A')})

- 综合评分:{product_data.get('rating', 'N/A')} / 5.0

- 评价数量:{product_data.get('review_count', 'N/A')} 条

- 库存状态:{product_data.get('availability', 'N/A')}

【重要提示】以上数据来自实时采集,请严格基于以上数据回答,

不得引用训练记忆中的历史数据,若数据不足以回答请如实说明。

"""

return f"{data_context}\n\n用户问题:{user_query}"

# ──────────────────────────────────────────────

# Step 4:Open Claw Agent 主函数

# 整合检索 + 生成的完整 RAG 链路

# ──────────────────────────────────────────────

def openclaw_amazon_agent(user_query: str, asin: str) -> str:

"""

Open Claw RAG Agent 主入口

1. 解析用户意图,提取目标 ASIN

2. 调用 Pangolinfo API 获取实时数据

3. 构建带真实数据的 Prompt

4. 调用大模型生成基于真实数据的回答

"""

# 获取实时亚马逊数据(RAG 检索阶段)

print(f"[RAG] 正在获取 ASIN {asin} 的实时亚马逊数据...")

product_data = fetch_amazon_product_data(asin)

# 构建注入了真实数据的 Prompt(RAG 增强阶段)

rag_prompt = build_rag_prompt(user_query, product_data)

# 调用大模型(生成阶段)

client = OpenAI() # 确保已配置 OPENAI_API_KEY 环境变量

response = client.chat.completions.create(

model="gpt-4o",

messages=[

{

"role": "system",

"content": "你是一位专业的亚马逊电商分析师。你必须且只能基于用户提供的实时数据进行分析,严禁引用任何训练记忆中的历史数据。如果提供的数据不足以回答,请明确告知用户需要补充哪些数据。"

},

{

"role": "user",

"content": rag_prompt

}

],

temperature=0.1 # 降低温度,减少创造性输出,鼓励基于数据的严格推理

)

return response.choices[0].message.content

# ──────────────────────────────────────────────

# 使用示例

# ──────────────────────────────────────────────

if __name__ == "__main__":

query = "这个产品现在的价格和排名怎么样?值得跟卖吗?"

asin = "B0XXXXXXXX" # 替换为实际目标 ASIN

result = openclaw_amazon_agent(query, asin)

print("\n[Agent 回答(基于实时数据)]")

print(result)

这份代码可以在 GitHub 的开源项目 openclaw-skill-pangolinfo 中找到完整版本,内含更多场景的示例和详细注释。

几个值得注意的工程细节

temperature 参数设置为 0.1 是有意为之——在数据驱动的分析场景,我们希望大模型”忠实于数据”,而不是”发挥创意”。实际测试中,temperature 从 0.7 降到 0.1 后,幻觉发生率下降超过 60%,结合 RAG 的数据注入,整体幻觉率接近零。

System Prompt 中的显式约束(”严禁引用训练记忆中的历史数据”)看起来冗余,实际上非常必要。大模型在 Context 数据和训练记忆冲突时,会倾向于补充训练记忆中的信息——明确的指令约束可以显著降低这种”混合幻觉”的概率。

对于高频 ASIN 监控场景,建议在 Pangolinfo API 调用层加一个短时间缓存(5-10 分钟),避免对同一 ASIN 的重复查询造成不必要的 API 消耗,同时保持数据的足够新鲜度。

总结:Open Claw 接入实时亚马逊数据是消灭幻觉的唯一可靠解法

大模型在电商场景产生幻觉,不是”偶发 bug”,而是由静态训练数据和动态实时市场之间的结构性矛盾决定的必然结果。Open Claw 接入实时亚马逊数据,通过 RAG 架构将实时采集的商品数据注入大模型的推理上下文,使 AI Agent 从”靠记忆猜测”切换到”基于实时数据推理”,这才是从根源上解决幻觉问题的正确路径。

Pangolinfo Scrape API 在亚马逊实时数据采集上的专业积累——分钟级数据时效、结构化 JSON 输出、98% SP 广告位采集率、千万级/天的稳定并发——使其成为 Open Claw 接入实时亚马逊数据时最自然的数据源选择。你的 AI Agent 应该说的每一句话都有数据依据,而不是靠模型的”自信”来蒙混过关。

如果你正在搭建或优化电商 AI Agent,建议从今天就开始测试 Pangolinfo 的数据接入,控制台提供免费试用额度,技术文档涵盖所有主流开发语言的接入示例。让你的 AI 彻底戒掉”瞎编”的习惯。

立即试用 Pangolinfo Scrape API,为你的 Open Claw Agent 接入实时亚马逊数据,从今天起让每一个 AI 回答都有据可查。