做亚马逊三年以上的卖家几乎都遇到过同一种沮丧:选品工具给出 8.7 分的「高机会类目」,砸钱备货上架后才发现头部三家把流量吃得死死的,差评里反复出现的需求自家产品根本没解决。问题不出在勤奋,出在亚马逊类目选品数据分析停留在了工具的「机会分」表面,没有把判断逻辑拆到 ASIN 级。

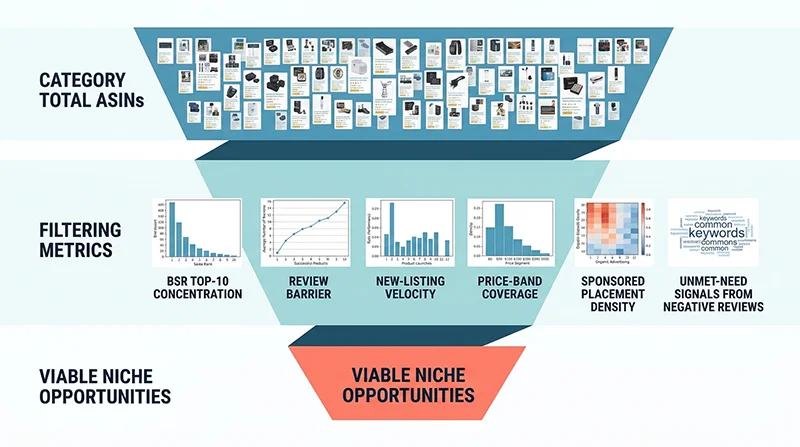

真正能用的类目分析必须回答三个具体问题:这个类目的销量集中在多少卖家手里?想冲进前 50 需要多少条评论垫底?现有产品的差评里藏着什么没被满足的需求?这三个问题任何一条没数据,工具的「8.7 分」都只是猜测。这篇文章会把六大判断维度逐个拆开,告诉你每个指标看哪些字段、怎么算、阈值落在哪里能视为可入场。

为什么只看 BSR 一定会踩坑

BSR(Best Seller Rank)几乎是所有选品教程的开场白,但单看 BSR 是 2018 年的玩法。一个类目里 BSR 1–10 名的产品月销 5000 单,11–100 名急剧滑落到月销 200 单,意味着这个类目的需求被头部彻底锁死,新进入者抢的不是用户,是头部品牌的预算池。亚马逊类目选品数据分析必须先看销量分布形态,再谈「这个类目热不热」。

更隐蔽的陷阱在 BSR 的更新机制本身。亚马逊每小时刷新一次 BSR,但销量计入是滞后加权的,意味着昨天爆单的 listing 可能今天 BSR 才跳上来。如果你只在选品当天截一个快照,看到的是「过去 24 小时已经发生的事」,而不是趋势。判断一个类目能不能进,至少需要 30 天的 BSR 时间序列,才能看出是季节性脉冲、稳定增长,还是单品爆款拉动的虚假繁荣。

第三个被忽略的细节:BSR 是按子类目排名的,但亚马逊有时会把同一款产品塞进多个子类目。一个产品在「Home & Kitchen」大类排 5000,但在「Kitchen & Dining > Coffee, Tea & Espresso > Coffee Filters」子类排第 3。如果你按大类看 BSR,会完全错过这种细分类目王。亚马逊品类选品研究的颗粒度必须下沉到子类目末级节点(Browse Node ID),上层数据只能用作初筛。

六个真正决定能否入场的数据维度

把工具的黑盒打开,亚马逊类目选品数据分析的判断逻辑可以拆解为六个互相独立的维度。每个维度都需要全量 ASIN 数据支撑,不是看 TOP100 就能判断的。

1. BSR 集中度(市场是不是被锁死)

计算方式:取类目末级节点下 TOP100 ASIN 的近 30 天估算销量,计算 TOP10 销量占 TOP100 总销量的比例(CR10)。这个数据回答了一个朴素问题:如果我冲进前 100,能分到多少蛋糕。

经验阈值:CR10 高于 70% 是典型红海,头部有强品牌护城河,新进入者除非有渠道或专利优势,否则三个月内难以撼动;CR10 在 40%–60% 之间是分散市场,长尾机会相对充足;CR10 低于 30% 经常意味着这个类目本身需求不足,热度不够,进去也吃不到量。蓝海窗口通常落在 35%–55% 之间。

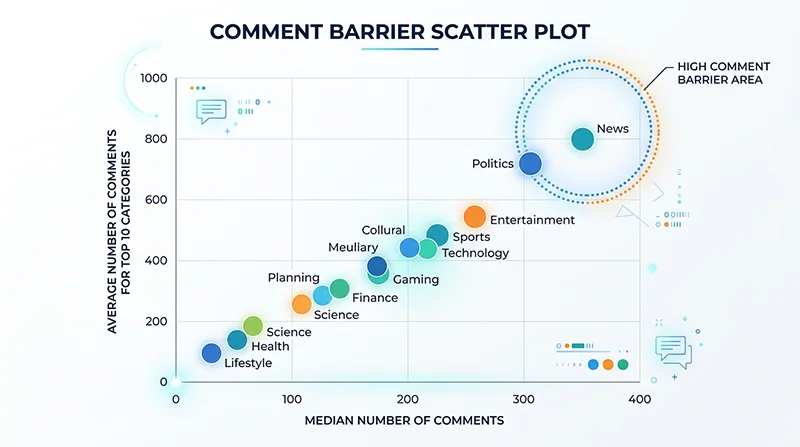

2. 评论壁垒(多少条评论才能站稳脚跟)

评论数是亚马逊算法权重的核心因子之一,也是新卖家最难短期补齐的资源。亚马逊利基市场数据分析必须把评论壁垒量化,而不是凭感觉「评论多就别进了」。

具体算法:取目标类目 BSR 1–50 名 ASIN 的评论数,看中位数和 P25 分位数。如果 P25(评论数较低端的 25% 分位)已经在 1500 条以上,意味着光想挤进前 50 都需要至少千条评论垫底,对新品来说至少六到九个月的评论积累期。如果 P25 在 200–500 之间,说明类目里仍有评论数较少的产品冲到前 50,存在新品突围窗口。

3. 新品速度(这个类目对新品友不友好)

定义:近 90 天内首次上架(First Seen 在 90 天内)且当前 BSR 进入 TOP200 的 ASIN 数量。这个指标直接告诉你,亚马逊算法在多大程度上愿意给新品流量。

新品速度大于 15 是非常友好的信号——说明类目对新品冷启动有结构性容忍度。低于 5 几乎可以判定是寡头格局,不是不能进,而是要做好 12 个月以上的烧钱预期。这个数据是亚马逊类目竞争分析方法里最难抓的一项,因为需要每周持续追踪类目快照对比新增 ASIN,不是一次性截图能拿到的。

4. 价格带覆盖(你的目标价格段有没有空位)

把类目 TOP200 的售价做直方图,看价格段的分布形态。如果你的目标定价是 $25,但 TOP200 里 $20–$30 的产品已经堆了 80 个,意味着这个价格段已经红得发紫,差异化空间极小;如果 $40–$50 段只有 5 个产品但都卖得不错,那这个价格段就是值得切入的窗口。

价格带分析的高级用法是结合评论数交叉:找出评论数 < 500 但销量进入类目 TOP100 的产品,这些产品的价格中位数往往就是「新品最容易破局」的价格锚点。这个交叉分析在所有市面工具里都没有现成功能,必须自己拉数据算。

5. SP 广告位密度(自然流量还剩多少)

这是被严重低估的一个维度。打开任何一个亚马逊搜索页,前两屏可能塞了 6–8 个 SP(Sponsored Products)广告位。如果你目标关键词的搜索结果页广告位占比超过 40%,意味着新品如果不投广告,几乎拿不到自然曝光。

判断方法:抓取目标核心关键词的 SERP(搜索结果页),统计前 48 个位置中 SP 标记位置的占比。如果这个比例长期高于 35%,准备好把广告预算占比提到 25% 以上才能有效冷启动。亚马逊的 SP 广告位采集是有难度的,行业里能做到 95% 以上识别率的并不多——这也是亚马逊数据采集能力直接决定选品分析准确度的典型场景。

6. 差评聚类(用户还在抱怨什么)

前五个维度回答「能不能进」,第六个维度回答「进去做什么差异化」。把目标类目 TOP30 ASIN 的所有 1–3 星评论拉下来,做高频词聚类和情感标注,会得到一份现成的「需求未满足清单」。

实操中你会发现,同一个类目的差评高度集中在 3–5 个具体痛点上。比如一个看似饱和的咖啡滤纸类目,把 TOP30 的差评跑一遍聚类,可能 60% 的负面集中在「漂白纸味重」「装杯口尺寸只适配一种咖啡机」「包装容易破」三个点上。如果你的产品能针对性解决其中一个,listing 的 bullet point 和 A+ 内容就有了天然的转化锚点。亚马逊的 Customer Says 板块是聚合好的高频词,但只显示前 6–10 个标签,更细的分布要靠完整评论抓取自己跑 NLP。

传统选品工具 vs 数据驱动方案

市面上 Helium 10、Jungle Scout、Sellersprite 这类成熟工具都提供「机会分」「市场细分」类指标,但有三个共同的局限。

第一,数据颗粒度被预先聚合。工具呈现的是类目级总数据,但真正的选品决策要看的是 ASIN 级原始数据:某个具体竞品 90 天的 BSR 走势、它的评论文本、它的价格变动节奏。聚合数据之后,你失去的是判断「为什么这个类目会出现这个机会分」的能力。

第二,更新频率受订阅档位制约。基础订阅档位通常是 24 小时甚至 48 小时刷新,对于做新品冷启动监控、广告位变化追踪这类高频场景明显不够。要拿到分钟级的实时数据,订阅成本会迅速攀升。

第三,数据无法二次组合。工具内的指标互相隔离,你想做「评论数 < 500 但销量 TOP100」这种交叉筛选,要么找不到入口,要么需要导出 CSV 自己用 Excel 拼。当你的选品决策开始进入「跨指标交叉分析」阶段,工具的封闭性就成了瓶颈。

替代方案是直接用数据 API 拉取 ASIN 级原始数据,自己在 BI 工具或 Python 里建分析模型。前期投入大一些,但一旦模型搭好,每次扩品的边际成本几乎为零,且所有分析逻辑都是透明的、可追溯的。

用 Pangolinfo Scrape API 搭建自己的类目分析底座

把上面六个维度落到工程实现上,需要的数据底座要满足三个条件:能按子类目末级节点拉全量 ASIN、能按时间序列追踪 BSR 与价格、能完整抓取评论文本而不是摘要。Pangolinfo Scrape API 是为这种场景设计的——支持亚马逊全品类的批量实时采集,输出结构化 JSON,可以直接接进 BI 仪表板或者数据仓库。

对应到六个维度的具体支持:BSR 集中度和新品速度需要类目快照接口,按 Browse Node ID 拉 TOP100/TOP200 的 ASIN 列表和销量估算;评论壁垒和差评聚类需要Reviews Scraper API 拉完整评论文本(含 Customer Says 全量高频词,不是只取前 6 个);SP 广告位密度需要 SERP 接口,Pangolinfo 在这个能力上的 SP 识别率行业领先,能识别到 98% 的广告位位置;价格带分析直接走商品详情接口,按时间序列存储就行。

对于不想自建分析层、希望开箱即用的团队,AMZ Data Tracker 把上述六个维度封装成了可视化仪表板,按类目订阅,所有指标按天更新,差评聚类用内置的 NLP 模型直接呈现高频痛点。如果团队里没有专门的数据工程师,这是更快的入门路径。

对于做利基市场扫描、需要批量评估几十甚至上百个潜在类目的团队,可以看一下亚马逊利基数据 API,预聚合了类目级的核心机会指标,省去了自己跑 BSR 集中度、评论分位数计算的工程量。

一段最小可用的代码示例

下面这段 Python 代码演示如何拉取一个目标类目的 TOP100 ASIN,并计算 BSR 集中度(CR10)。这是六个维度里最基础的一项,落地之后其他维度只是把同一套数据管道接到不同接口上。

import requests

import pandas as pd

API_KEY = "your_pangolinfo_api_key"

# Pangolinfo Amazon Scrape API(同步端点 v1)。

# 业务通过 parserName 字段区分(amzProductDetail / amzKeyword /

# amzProductOfCategory / amzProductOfSeller / amzBestSellers / amzNewReleases)。

# 返回结构:{ code, message, data: { json: [...], url, taskId } }

# 完整文档:https://docs.pangolinfo.com/cn-api-reference/universalApi/universalApi

BASE_URL = "https://scrapeapi.pangolinfo.com/api/v1/scrape"

SITE_MAP = {"US": "www.amazon.com", "DE": "www.amazon.de",

"UK": "www.amazon.co.uk", "JP": "www.amazon.co.jp"}

def fetch_category_listings(node_id, marketplace="US", zipcode="10041"):

"""通过 amzProductOfCategory 解析器按类目 Node ID 拉取商品列表。"""

payload = {

"parserName": "amzProductOfCategory",

"content": node_id, # 类目 Node ID

"site": SITE_MAP[marketplace],

"format": "json", # 也可选 rawHtml / markdown

"bizContext": {"zipcode": zipcode}, # 指定邮区(影响价格/配送显示)

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json",

}

resp = requests.post(BASE_URL, json=payload, headers=headers, timeout=30)

resp.raise_for_status()

return resp.json()["data"]["json"] # 解析后的结构化商品列表

def compute_cr10(listings):

"""CR10 = TOP10 销量 / TOP100 销量。

注:Amazon 公开数据只有 BSR 排名(bestSellersRank 字段),没有原始销量。

estimated_monthly_sales 需自行从 BSR 反推(行业公式或 Sales Estimator),

或直接用 AMZ Data Tracker 内已封装的销量估算结果。"""

df = pd.DataFrame(listings)

df = df.sort_values("estimated_monthly_sales", ascending=False).reset_index(drop=True)

top10 = df.head(10)["estimated_monthly_sales"].sum()

total = df.head(100)["estimated_monthly_sales"].sum()

return top10 / total if total > 0 else 0

# 示例:分析 Coffee Filters 子类目(Node ID = 2251606011)

data = fetch_category_listings(node_id="2251606011", marketplace="US")

cr10 = compute_cr10(data)

print(f"CR10: {cr10:.1%}")

if cr10 > 0.70:

print("→ 红海类目,头部锁死,慎入")

elif 0.35 <= cr10 <= 0.55:

print("→ 分散市场,存在长尾机会,进入下一轮指标筛选")

else:

print("→ 市场过于分散或需求不足,需结合销量绝对值再判断")

把这段代码扩展成完整六维分析需要再补五个数据接口和对应的计算函数,但骨架就是这样。所有指标都是透明的、可解释的、可以版本化追踪的——这是亚马逊 BSR 数据选品决策从「凭直觉」走向「可复现」的关键一步。

把选品当成可迭代的数据工程

亚马逊类目选品数据分析的本质,不是找一个「最优选品工具」,而是把选品决策从经验直觉迁移到可解释的数据框架上。BSR 集中度告诉你市场结构,评论壁垒告诉你时间成本,新品速度告诉你算法态度,价格带告诉你定价空间,SP 广告密度告诉你流量获取成本,差评聚类告诉你差异化锚点——六个维度交叉之后,「这个类目能不能进」就不再是赌博。

更重要的是,一旦你把这套分析框架沉淀成自动化数据管道,下一次扩品的边际成本几乎为零。每周扫描 100 个潜在子类目,让六个指标自动打分排序,团队的精力就可以集中在最有希望的 5–10 个类目上做深度调研。这是工具型选品做不到的复利效应。

如果你正在为下一个产品线做调研,不妨先选 1–2 个候选类目,用上面的六个维度跑一遍,看看跟你直觉判断的差距在哪。这往往是从「拍脑袋扩品」转向「数据驱动选品」的最低成本起点。

立即试用:注册 Pangolinfo Scrape API 免费额度(查看 API 文档),用真实数据跑一遍你的目标类目;或直接用 AMZ Data Tracker 体验六维仪表板。

![Amazon电商数据分析方法:2025跨境电商数据采集工具与合规获取方案完全指南[万字长文] 5 Amazon电商数据 Amazon Seller Data Analysis](https://www.pangolinfo.com/wp-content/uploads/2025/05/Amazon-E-commerce-Data-22@0.75x.jpg)