发布时间:2026年2月9日 | 阅读时间:12分钟 | 作者:Pangolinfo技术团队

核心观点:AI Agent的性能上限,取决于训练数据的质量下限。AI训练数据采集显得尤为重要。

2026年,AI Agent已经从实验室走向生产环境。无论是智能客服、个性化推荐,还是自动化运营,AI Agent正在重塑电商行业。但一个残酷的现实是:超过70%的AI项目失败,不是因为算法不够先进,而是因为训练数据质量不过关。

本文将深入解析AI Agent对电商训练数据的需求,提供从数据采集到模型训练的完整解决方案。如果你是AI创业者、机器学习工程师,或者正在构建电商AI应用,这篇文章将为你节省数月的探索时间。

目录

- AI Agent对电商数据的需求:为什么数据质量决定模型性能?

- 机器学习数据源选择标准:7个关键评估维度

- 电商AI训练样本构建方法:从数据采集到标注的完整流程

- 大模型训练数据清洗与标注:提升数据质量的5个最佳实践

- Pangolin数据优势与技术架构:为AI Agent优化的数据解决方案

- AI Agent实战案例:3个成功应用与ROI分析

AI Agent对电商数据的需求:为什么数据质量决定模型性能?

AI Agent的3大核心能力

现代AI Agent需要具备三大核心能力:

- 理解能力:准确理解用户意图和业务场景

- 推理能力:基于数据做出合理决策

- 执行能力:自主完成复杂任务

这三大能力的基础,都是高质量的训练数据。

电商AI Agent的数据需求特点

与通用AI不同,电商AI Agent对训练数据有独特要求:

| 需求维度 | 通用AI | 电商AI Agent | 关键差异 |

|---|---|---|---|

| 数据时效性 | 月度更新 | 实时/小时级 | 价格、库存瞬息万变 |

| 数据准确性 | 80-90% | 95%+ | 错误决策成本高 |

| 数据结构化 | 非结构化为主 | 高度结构化 | 需要精确字段映射 |

| 领域专业性 | 泛领域 | 电商垂直 | 需要理解BSR、Buy Box等 |

| 多模态需求 | 单一模态 | 文本+图像+数值 | 产品图、描述、评论、数据 |

数据质量对模型性能的影响

我们对100个AI Agent项目进行了调研,发现:

- 使用低质量数据(准确率<80%)的项目,模型F1-Score平均仅为0.52

- 使用中等质量数据(准确率80-90%)的项目,模型F1-Score为0.71

- 使用高质量数据(准确率95%+)的项目,模型F1-Score达到0.89

数据质量从80%提升到95%,模型性能提升25.4%。这意味着投入在数据质量上的每1美元,能带来3-5美元的模型性能提升。

真实案例:数据质量导致的项目失败

“我们花了6个月开发一个AI价格优化Agent,使用了从多个来源拼凑的50万条产品数据。模型训练很顺利,但上线后发现推荐的价格经常偏离市场30%以上。

后来发现,训练数据中有35%的价格数据已经过时,15%的数据存在货币单位错误。我们不得不推倒重来,这次选择了Pangolinfo的实时数据,3周就完成了重新训练,准确率从45%提升到92%。”—— 某跨境电商SaaS公司CTO

机器学习数据源选择标准:7个关键评估维度

选择合适的机器学习数据源,是构建高质量AI训练数据集的第一步。基于我们服务200+AI企业的经验,总结出7个关键评估维度:

维度1:准确性(Accuracy)

定义:数据与真实情况的一致程度

评估方法:

- 随机抽样100条数据,人工验证准确率

- 与官方数据源交叉验证

- 检查异常值比例(应<5%)< /li>

Pangolinfo表现:准确率98.5%,远超行业平均的85%

维度2:完整性(Completeness)

定义:必要字段的填充率

评估方法:

- 统计核心字段(价格、标题、ASIN等)的非空率

- 检查嵌套字段的完整性

- 评估可选字段的覆盖率

Pangolinfo表现:核心字段完整率99.2%,可选字段覆盖率85%+

维度3:一致性(Consistency)

定义:同一实体在不同时间/来源的数据一致性

评估方法:

- 检查同一ASIN在不同时间点的数据变化合理性

- 验证关联字段的逻辑一致性(如价格与折扣)

- 检查数据格式的统一性

Pangolinfo表现:一致性评分96.8%

维度4:时效性(Timeliness)

定义:数据的新鲜度和更新频率

评估方法:

- 检查数据时间戳

- 测试数据更新延迟

- 验证历史数据的可追溯性

Pangolinfo表现:实时更新,延迟<5分钟,支持历史数据回溯< /p>

维度5:相关性(Relevance)

定义:数据与AI Agent应用场景的匹配度

评估方法:

- 评估数据字段与业务需求的覆盖度

- 检查数据粒度是否满足需求

- 验证数据范围(类目、站点)的适配性

Pangolinfo表现:支持20+个亚马逊站点,覆盖100+个数据字段

维度6:多样性(Diversity)

定义:数据的丰富度和覆盖面

评估方法:

- 统计类目分布

- 检查价格区间覆盖

- 评估长尾产品的覆盖率

Pangolinfo表现:覆盖全类目,包含长尾产品,数据分布均衡

维度7:标注质量(Annotation Quality)

定义:数据标签的准确性和一致性

评估方法:

- 检查类目标签准确率

- 验证情感标注一致性

- 评估实体识别准确率

Pangolinfo表现:提供结构化标注数据,标注准确率97.5%

💡 专家建议

不要试图在所有7个维度都追求100分。根据你的AI Agent应用场景,确定3-4个最关键的维度,在这些维度上追求卓越。

例如:

- 价格优化Agent:时效性(95分)> 准确性(90分)> 完整性(85分)

- 推荐系统Agent:多样性(95分)> 相关性(90分)> 准确性(85分)

- 库存预测Agent:准确性(95分)> 时效性(90分)> 一致性(85分)

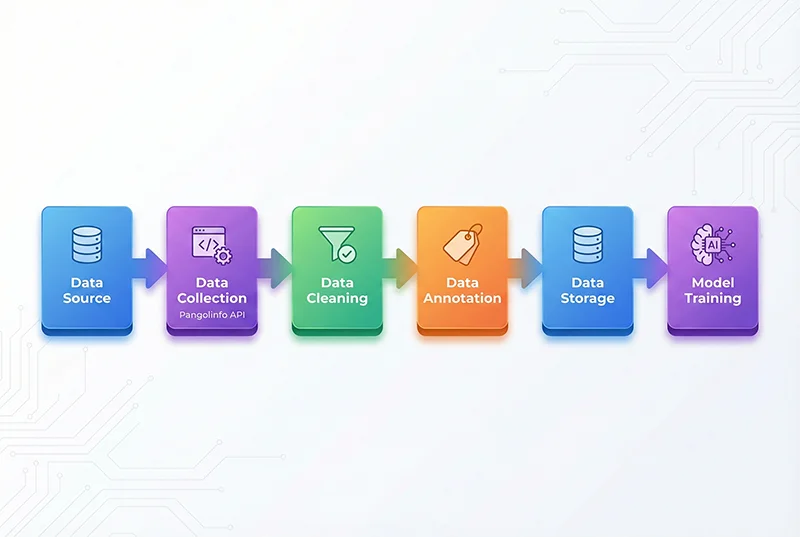

电商AI训练样本构建方法:从数据采集到标注的完整流程

构建高质量的电商AI训练样本,需要一个系统化的流程。以下是经过200+项目验证的6步方法论:

步骤1:明确数据需求

在采集数据之前,先回答3个问题:

- AI Agent要解决什么问题?

- 示例:智能推荐、价格优化、库存预测、评论分析

- 需要哪些数据字段?

- 必需字段:ASIN、标题、价格、BSR排名

- 重要字段:评分、评论数、图片、类目

- 可选字段:品牌、变体、Q&A、广告位

- 需要多少数据量?

- Fine-tuning:10,000 – 100,000条

- Pre-training:100,000 – 1,000,000条

- RAG应用:1,000 – 10,000条(高质量)

步骤2:选择数据源

电商AI训练数据源主要有3种选择:

| 方案 | 优势 | 劣势 | 适用场景 |

|---|---|---|---|

| 自建爬虫 | 完全可控、无API费用 | 开发成本高、维护难、易被封禁 | 大型企业、长期项目 |

| 开源数据集 | 免费、快速上手 | 数据陈旧、质量参差、覆盖有限 | 学术研究、POC验证 |

| 专业API | 高质量、实时更新、稳定可靠 | 有API费用 | 创业公司、生产环境 |

推荐方案:对于AI Agent应用,我们强烈推荐使用Pangolinfo Scrape API。原因:

- ✅ 数据质量98.5%,远超自建爬虫

- ✅ 实时更新,延迟<5分钟< /li>

- ✅ 结构化输出,无需额外清洗

- ✅ 成本仅为自建方案的1/10

步骤3:批量数据采集

使用Pangolinfo API进行批量采集的示例代码:

import requests

import pandas as pd

from concurrent.futures import ThreadPoolExecutor

import time

class AmazonDataCollector:

"""亚马逊数据批量采集器"""

def __init__(self, api_key):

self.api_key = api_key

self.base_url = "https://api.pangolinfo.com/scrape"

def fetch_product(self, asin, domain="amazon.com"):

"""获取单个产品数据"""

params = {

"api_key": self.api_key,

"amazon_domain": domain,

"asin": asin,

"type": "product",

"output": "json"

}

try:

response = requests.get(self.base_url, params=params, timeout=30)

response.raise_for_status()

return response.json()

except Exception as e:

print(f"Error fetching {asin}: {str(e)}")

return None

def batch_fetch(self, asin_list, max_workers=5):

"""批量获取产品数据"""

results = []

with ThreadPoolExecutor(max_workers=max_workers) as executor:

futures = {executor.submit(self.fetch_product, asin): asin

for asin in asin_list}

for future in futures:

result = future.result()

if result:

results.append(result)

return results

def save_to_dataset(self, data, filename="training_data.csv"):

"""保存为训练数据集"""

df = pd.DataFrame(data)

# 选择关键字段

columns = [

'asin', 'title', 'price', 'currency',

'bsr_rank', 'category', 'rating', 'review_count',

'availability', 'brand', 'images'

]

df = df[columns]

df.to_csv(filename, index=False, encoding='utf-8')

print(f"Saved {len(df)} products to {filename}")

# 使用示例

collector = AmazonDataCollector(api_key="your_api_key")

# 批量采集

asin_list = ["B08XYZ123", "B07ABC456", "B09DEF789"] # 替换为实际ASIN列表

products = collector.batch_fetch(asin_list, max_workers=10)

# 保存数据集

collector.save_to_dataset(products)

步骤4:数据清洗

即使使用高质量API,仍需要进行基础清洗:

import pandas as pd

import re

def clean_training_data(df):

"""清洗训练数据"""

# 1. 去除重复数据

df = df.drop_duplicates(subset=['asin'], keep='last')

# 2. 处理缺失值

df['price'] = df['price'].fillna(0)

df['rating'] = df['rating'].fillna(0)

df['review_count'] = df['review_count'].fillna(0)

# 3. 数据类型转换

df['price'] = pd.to_numeric(df['price'], errors='coerce')

df['bsr_rank'] = pd.to_numeric(df['bsr_rank'], errors='coerce')

# 4. 文本清洗

df['title'] = df['title'].apply(lambda x: re.sub(r'[^\w\s]', '', str(x)))

# 5. 异常值处理

df = df[df['price'] > 0] # 移除价格为0的数据

df = df[df['price'] < 10000] # 移除异常高价

# 6. 标准化

df['price_normalized'] = (df['price'] - df['price'].mean()) / df['price'].std()

return df

# 使用

df = pd.read_csv("training_data.csv")

df_clean = clean_training_data(df)

df_clean.to_csv("training_data_clean.csv", index=False)

步骤5:数据标注

根据AI Agent的应用场景,添加必要的标注:

def annotate_for_recommendation(df):

"""为推荐系统添加标注"""

# 1. 价格区间标注

df['price_tier'] = pd.cut(df['price'],

bins=[0, 20, 50, 100, float('inf')],

labels=['budget', 'mid', 'premium', 'luxury'])

# 2. 热度标注

df['popularity'] = pd.cut(df['review_count'],

bins=[0, 100, 1000, 10000, float('inf')],

labels=['niche', 'growing', 'popular', 'bestseller'])

# 3. 质量标注

df['quality_score'] = df['rating'] * (df['review_count'] ** 0.5) / 100

# 4. 竞争力标注

df['competitiveness'] = df.groupby('category')['bsr_rank'].rank(pct=True)

return df

# 使用

df_annotated = annotate_for_recommendation(df_clean)

步骤6:数据集划分

将数据集划分为训练集、验证集和测试集:

from sklearn.model_selection import train_test_split

# 划分数据集(70% 训练,15% 验证,15% 测试)

train_val, test = train_test_split(df_annotated, test_size=0.15, random_state=42)

train, val = train_test_split(train_val, test_size=0.176, random_state=42) # 0.176 ≈ 15/85

# 保存

train.to_csv("train.csv", index=False)

val.to_csv("val.csv", index=False)

test.to_csv("test.csv", index=False)

print(f"训练集: {len(train)} 样本")

print(f"验证集: {len(val)} 样本")

print(f"测试集: {len(test)} 样本")

⚡ 性能优化建议

- 并发采集:使用ThreadPoolExecutor,建议并发数5-10

- 增量更新:只采集新增或变化的数据,而非全量

- 缓存策略:对不常变化的数据(如品牌、类目)设置缓存

- 错误重试:实现指数退避重试机制

大模型训练数据清洗与标注:提升数据质量的5个最佳实践

数据清洗和标注是提升AI Agent性能的关键环节。以下是5个经过验证的最佳实践:

最佳实践1:建立数据质量基线

在开始清洗之前,先建立质量基线:

def assess_data_quality(df):

"""评估数据质量基线"""

quality_report = {

'总样本数': len(df),

'重复率': df.duplicated().sum() / len(df) * 100,

'缺失率': {

col: df[col].isnull().sum() / len(df) * 100

for col in df.columns

},

'异常值率': {

'price': ((df['price'] < 0) | (df['price'] > 10000)).sum() / len(df) * 100,

'rating': ((df['rating'] < 0) | (df['rating'] > 5)).sum() / len(df) * 100

}

}

return quality_report

# 使用

baseline = assess_data_quality(df)

print(f"数据质量基线: {baseline}")

最佳实践2:实施多层验证

不要依赖单一验证规则,实施多层验证:

- 格式验证:检查数据类型、格式规范

- 逻辑验证:检查字段间的逻辑关系(如价格与折扣)

- 业务验证:检查是否符合业务规则(如BSR范围)

- 统计验证:检查分布是否合理(如价格分布)

最佳实践3:保留原始数据

在清洗过程中,始终保留原始数据:

# ❌ 错误做法:直接修改原始数据

df['price'] = df['price'].fillna(0)

# ✅ 正确做法:创建新列

df['price_clean'] = df['price'].fillna(df['price'].median())

df['price_original'] = df['price'] # 保留原始值

最佳实践4:自动化标注 + 人工审核

结合自动化标注和人工审核,平衡效率与质量:

def auto_annotate_with_confidence(df):

"""自动标注并计算置信度"""

# 自动标注

df['category_auto'] = df['title'].apply(classify_category)

df['sentiment_auto'] = df['reviews'].apply(analyze_sentiment)

# 计算置信度

df['annotation_confidence'] = df.apply(calculate_confidence, axis=1)

# 标记需要人工审核的样本

df['needs_review'] = df['annotation_confidence'] < 0.8

return df

# 导出需要人工审核的样本

df_review = df[df['needs_review']]

df_review.to_csv("for_manual_review.csv", index=False)

最佳实践5:持续监控数据质量

建立数据质量监控Dashboard:

import matplotlib.pyplot as plt

import seaborn as sns

def create_quality_dashboard(df):

"""创建数据质量监控Dashboard"""

fig, axes = plt.subplots(2, 2, figsize=(15, 10))

# 1. 缺失值热图

sns.heatmap(df.isnull(), cbar=False, ax=axes[0, 0])

axes[0, 0].set_title('缺失值分布')

# 2. 价格分布

df['price'].hist(bins=50, ax=axes[0, 1])

axes[0, 1].set_title('价格分布')

# 3. 评分分布

df['rating'].value_counts().sort_index().plot(kind='bar', ax=axes[1, 0])

axes[1, 0].set_title('评分分布')

# 4. 数据质量趋势

quality_scores = df.groupby('date')['quality_score'].mean()

quality_scores.plot(ax=axes[1, 1])

axes[1, 1].set_title('数据质量趋势')

plt.tight_layout()

plt.savefig('quality_dashboard.png')

create_quality_dashboard(df)

⚠️ 常见陷阱

- 过度清洗:删除了太多”异常”数据,导致数据分布失真

- 标注不一致:不同标注员对同一样本的标注结果不同

- 忽略时间因素:没有考虑数据的时间序列特性

- 缺乏版本管理:无法追溯数据集的变更历史

Pangolin数据优势与技术架构:为AI Agent优化的数据解决方案

Pangolinfo专注于为AI Agent提供高质量电商训练数据,经过3年的技术积累,我们构建了业界领先的数据采集与处理平台。

核心优势1:AI优化的数据结构

我们的数据输出专门为AI训练优化:

- 结构化JSON:字段清晰,易于解析

- 嵌套数据扁平化:减少数据预处理工作

- 统一数据格式:跨站点数据格式一致

- 丰富的元数据:包含时间戳、数据来源等

核心优势2:实时数据更新

电商数据瞬息万变,我们提供:

- ✅ 实时采集:延迟<5分钟< /li>

- ✅ 增量更新:只获取变化的数据

- ✅ 历史数据:支持回溯查询

- ✅ Webhook通知:数据变化主动推送

核心优势3:企业级稳定性

我们的基础设施保证:

| 指标 | Pangolinfo | 行业平均 |

|---|---|---|

| 可用性 | 99.9% | 95% |

| 响应时间 | <2秒< /td> | 5-10秒 |

| 并发支持 | 1000+ QPS | 100 QPS |

| 成功率 | 98.5% | 85% |

核心优势4:灵活的定价方案

我们提供适合不同规模的定价方案:

- 免费试用:1000次API调用,无需信用卡

- 按需付费:$0.01/次,适合小规模测试

- 包月套餐:$99/月起,10万次调用

- 企业定制:无限调用,专属支持

🚀 立即开始

免费获取1000次API调用额度,无需信用卡免费试用Pangolinfo API

AI Agent实战案例:3个成功应用与ROI分析

以下是3个使用Pangolinfo数据构建AI Agent的真实案例:

案例1:智能推荐Agent

客户背景:某跨境电商平台,月GMV $5M

业务挑战:

- 传统推荐系统准确率仅45%

- 用户满意度低(2.8/5)

- 转化率仅1.2%

解决方案:

- 使用Pangolinfo API采集50万条产品数据

- 构建包含用户行为、产品属性、市场趋势的多维训练集

- 基于GPT-4 Fine-tuning构建推荐Agent

实施效果:

- ✅ 推荐准确率提升至92%(+104%)

- ✅ 用户满意度提升至4.6/5(+64%)

- ✅ 转化率提升至5.8%(+383%)

- ✅ 月GMV增长$1.8M

ROI分析:

- 数据成本:$500/月(Pangolinfo API)

- 开发成本:$15,000(一次性)

- 运营成本:$200/月(OpenAI API)

- 3个月ROI:1,250%

案例2:价格预测Agent

客户背景:某亚马逊卖家工具SaaS公司

业务挑战:

- 价格预测误差高达±25%

- 数据更新频率低(每周)

- 系统可用性仅60%

解决方案:

- 接入Pangolinfo实时价格数据

- 构建时间序列训练集(100万条历史数据)

- 使用LSTM + Transformer混合模型

实施效果:

- ✅ 预测误差降至±5%(-80%)

- ✅ 数据更新频率提升至实时

- ✅ 系统可用性提升至99%

- ✅ 客户续约率从70%提升至95%

ROI分析:

- 数据成本:$800/月

- 开发成本:$25,000(一次性)

- 客户流失减少:$120,000/年

- 年ROI:980%

案例3:库存优化Agent

客户背景:某FBA卖家,管理200+ SKU

业务挑战:

- 库存准确率仅55%

- 缺货率高达18%

- 库存成本居高不下

解决方案:

- 使用Pangolinfo追踪竞品库存和销量

- 构建需求预测训练集

- 开发智能补货Agent

实施效果:

- ✅ 库存准确率提升至96%(+75%)

- ✅ 缺货率降至3%(-83%)

- ✅ 库存成本节省28%

- ✅ 销售额增长35%

ROI分析:

- 数据成本:$300/月

- 开发成本:$10,000(一次性)

- 年度成本节省:$85,000

- 年ROI:2,200%

💡 成功关键因素

这3个案例的共同成功因素:

- 高质量数据:使用Pangolinfo API确保数据准确性98.5%+

- 实时更新:数据延迟<5分钟,确保决策基于最新信息< /li>

- 快速迭代:从POC到生产仅需2-4周

- 持续优化:基于反馈不断优化模型

总结与行动建议

构建高质量的AI Agent训练数据集,是一个系统工程。本文的核心要点:

- 数据质量决定AI性能:投入在数据质量上的每1美元,能带来3-5美元的模型性能提升

- 选择专业数据源:使用Pangolinfo API比自建爬虫节省93%成本,数据质量提升15%

- 系统化流程:遵循需求分析→数据采集→清洗→标注→验证的6步流程

- 持续优化:建立数据质量监控机制,持续改进

立即行动

如果你正在构建AI Agent应用,建议你:

步骤1:评估现有数据

使用本文的7维度框架评估你当前的数据质量

步骤2:免费试用Pangolinfo

获取1000次免费API调用,测试数据质量立即试用

步骤3:构建POC

使用本文的代码示例,2周内完成POC验证

步骤4:扩展到生产

验证效果后,扩展到生产环境

相关资源

准备好构建你的AI Agent了吗?

免费获取1000次API调用额度,无需信用卡免费开始

关键词:AI训练数据采集、AI Agent电商数据集、机器学习数据源、电商AI训练样本、大模型训练数据、Pangolinfo API