摘要

跨境电商精细化竞争时代,人工+工具的传统运营模式正在被颠覆。亚马逊运营智能体,作为集自主决策、自动执行、持续迭代于一体的 AI 系统,正在成为头部卖家建立运营壁垒的核心基础设施。本文系统拆解搭建亚马逊运营智能体的完整方法论:场景化设计是前提、技术架构是骨架、数据源是血液、闭环迭代是灵魂。通过手把手的实施框架与代码示例,帮助卖家、运营负责人和技术团队从零开始落地智能体,实现从人工决策到 AI 自主运营的跃迁。

一、引言:亚马逊运营正式进入”智能体时代”

如果你的团队还在每天早上手动刷新亚马逊后台、逐条查看广告报告、用 Excel 跟踪竞品价格变化,那么你正在经历的,正是传统运营模式面临淘汰之前最后的”平静时光”。

亚马逊平台的竞争烈度在过去三年发生了结构性变化。SKU 数量爆炸、广告成本持续攀升、运营 SOP 越来越复杂,而市场留给每一个决策窗口的反应时间却越来越短。一个关键词的出价策略可能需要在 4 小时内响应竞品的价格动作;一条差评如果没有在 24 小时内妥善处理,就可能引发一连串的转化率下滑;一个新品榜单机会,从出现到被竞争对手发现,有时只有 1-2 周的时间差。

这种高频、高强度、高复杂度的运营需求,早已超出了人工+传统工具的承载上限。数据显示,头部亚马逊运营团队平均每人管理的 SKU 超过 300 个,每天需要处理的数据维度超过 50 个,而可用于深度分析的时间却往往不足 2 小时。这个矛盾,不是招募更多运营人员能解决的。

亚马逊运营智能体(Amazon Operations AI Agent)的出现,提供了一种截然不同的解法。它不是一个新的”工具”,而是一个能够自主感知运营状态、分析数据洞察、做出决策、自动执行操作并持续从结果中学习的”AI 合伙人”。与传统 RPA 机器人或数据看板相比,智能体的核心差异在于:它有推理能力、有记忆、会学习,并且能够跨任务协同工作。

本文的目标,是给你一份可以真正落地的亚马逊运营智能体搭建指南——不是概念科普,而是从需求定义到代码实现、从数据接入到上线监控的完整操作手册。

二、亚马逊运营智能体:定义与核心能力边界

2.1 什么是亚马逊运营智能体

亚马逊运营智能体是一套基于大语言模型(LLM)+ 工具调用(Tool Use)+ 记忆系统(Memory)构建的自主 AI 系统,能够覆盖亚马逊运营全链路,完成自主决策、自动执行和闭环优化的完整循环。

用更具体的方式描述:当你设定”ACoS 目标低于 15%”这一目标后,广告智能体会自动监控当前 ACoS 走势,一旦发现某个广告组 ACoS 连续 3 天超过阈值,它会分析原因(是点击价格过高?是转化率下降?还是竞品投放加密?),然后自动调整出价策略或暂停表现差的关键词,并将操作日志发送给你确认——整个过程无需人工介入。

这与传统工具的本质区别在于:传统工具是”被动响应”,你告诉它做什么它才做;而智能体是”主动感知”,它能理解目标、自主规划路径、跨越多步骤执行,并在结果反馈中持续优化。

2.2 六大核心能力模块

一个完整的亚马逊运营智能体生态,通常由以下六个专项智能体协同构成:

① 选品与市场分析智能体:持续扫描 BSR 榜单变化、新品爆发信号、竞品销量估算、类目竞争密度,自动生成选品评分报告和市场机会预警。输出:每日市场简报、候选新品推荐列表、竞争度评估矩阵。

② Listing 撰写/优化/合规智能体:基于关键词数据和竞品分析,自动起草或优化标题、五点描述、A+内容,并进行合规预检(品牌限制词、禁用词、类目特殊要求)。输出:Listing 初稿、优化建议报告、合规风险清单。

③ 广告投放与 ACoS 优化智能体:实时监控广告活动表现,自动执行关键词出价调整、预算分配优化、否定关键词管理,支持 SP/SB/SD 三种广告类型。输出:每日广告操作日志、周期性策略调整报告。

④ 库存与 FBA 物流智能体:基于销量趋势、季节性波动、FBA 补货时效,自动计算补货时间窗口和安全库存量,发出补货预警并生成采购建议。输出:补货预警、库存健康报告、FBA 费用优化建议。

⑤ 客服与评论管理智能体:自动识别差评、中性评论和关键 Q&A,生成个性化回复草稿;对于高风险差评自动触发人工复核流程;统计评论情感趋势并归因到产品或运营问题。输出:日常回复草稿、差评预警、情感分析月报。

⑥ 竞品监控与风险预警智能体:持续跟踪核心竞品的定价、排名、评论和广告位变化,当检测到重大异动(如竞品大幅降价、刷榜行为、新竞争者入场)时立即触发预警。输出:竞品动态日报、威胁评级预警。

2.3 与传统 RPA / 工具的本质区别

很多卖家在了解智能体之前,已经使用了 RPA 工具或各类 SaaS 运营平台。它们的差异值得厘清,以避免期望错位:

| 维度 | 传统工具/RPA | 亚马逊运营智能体 |

|---|---|---|

| 决策能力 | 固定规则、无推理能力 | LLM 推理,理解上下文,灵活决策 |

| 任务范围 | 单点任务,不跨模块 | 跨任务协同,全链路覆盖 |

| 学习能力 | 规则不变,无自我更新 | 基于反馈持续优化提示词和策略 |

| 异常处理 | 遇到未定义情况即停止 | 能推断意图,给出备选方案 |

| 记忆能力 | 无上下文记忆 | 长短期记忆,积累运营知识库 |

三、搭建亚马逊运营智能体的 6 大核心要点

要点一:场景化能力拆解——不做通用 AI,聚焦高价值场景

搭建亚马逊运营智能体最常见的第一个错误,是试图一步到位地构建一个”全能 AI”。这条路几乎必然失败:通用 AI 对亚马逊运营的理解不够深,在任何单一场景上的表现都达不到可信赖的水平,团队也无法在如此宽泛的范围内进行有效的质量验证。

正确的做法是严格场景化:先选定一个”高重复、高价值、低风险”的场景作为切入点,把这个场景做深、做透,积累信心和经验后再横向扩展。

评估场景优先级的三个维度:

- 重复频率:日常操作频次越高的任务,自动化收益越大(广告出价调整 > 季节性选品)

- 决策价值:错误决策造成的损失越大,正确决策带来的收益越高(广告优化 > 邮件回复模板)

- 数据可得性:该场景所需数据是否已经可以稳定获取(有明确 API 接口优先)

建议首期 MVP 优先选择以下三个场景之一:广告 ACoS 监控与自动出价调整(数据完整、规则清晰、可量化效果)、差评监控与回复草稿生成(操作量大、时效性要求高、LLM 能力能直接发挥)、库存安全线预警与补货建议(决策逻辑相对固定、风险有限)。

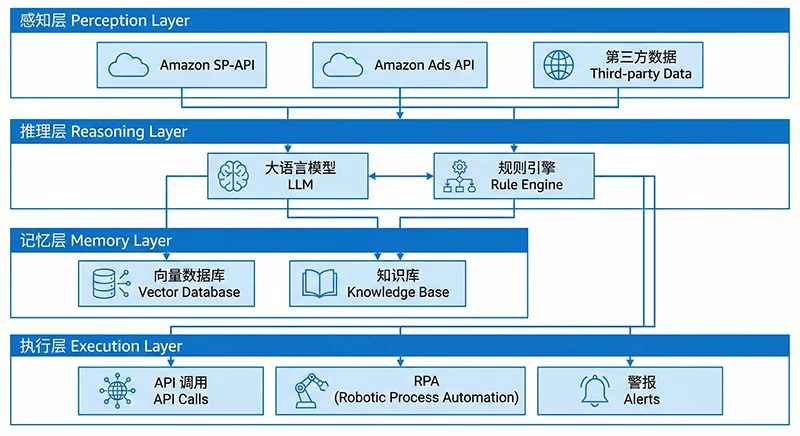

要点二:技术架构——四层架构是骨架

一个生产可用的亚马逊运营智能体,需要以下四层技术架构协同工作:

第一层:感知层(Perception Layer)

负责从各类数据源获取运营所需的实时信息。数据来源包括:亚马逊 SP-API(店铺订单、库存、绩效、FBA 数据)、广告 API(广告活动数据)、第三方数据 API(市场公域数据,如 Pangolinfo Scrape API 提供的 BSR/关键词/竞品数据)以及用户行为数据(评论、Q&A)。

第二层:推理层(Reasoning Layer)

智能体的”大脑”,由大语言模型(LLM)和规则引擎共同构成。LLM 负责处理需要语义理解、上下文推理和复杂判断的任务(如分析差评情感、生成 Listing 优化建议);规则引擎负责处理确定性强的逻辑(如”库存天数低于 14 天触发补货”、”ACoS 超过 20% 降价出价”),以确保可审计性和一致性。

第三层:记忆层(Memory Layer)

智能体的”记忆系统”,通常由向量数据库(存储运营历史决策、产品知识库、SOP 文档)和关系型数据库(存储结构化运营数据时间序列)共同构成。记忆层让智能体能够记住”上次这个竞品降价后发生了什么”,从历史中学习并优化未来决策。

第四层:执行层(Execution Layer)

将决策转化为实际操作:通过 SP-API 修改 Listing 内容、通过广告 API 调整出价、通过 RPA 机器人完成 SP-API 暂未开放的界面操作、通过 Webhook 向 Slack/企业微信推送告警通知。执行层必须设计严格的操作审批机制,区分”自动执行”和”人工审核后执行”两类操作,高风险操作(如删除广告活动、修改价格超过 20%)一律进入人工审核队列。

要点三:数据底座——先建数据基础设施,再谈智能体

数据底座是智能体能否正常运作的先决条件,也是最容易被低估的环节。在开始任何智能体代码开发之前,团队需要完成三件事:

第一,数据接入盘点:梳理你目前能够合规获取的数据清单——哪些数据通过 SP-API 已经可以拿到?哪些竞品和市场数据需要第三方数据服务补充?哪些数据当前根本不可得(需要暂时在智能体设计中规避)?

第二,数据标准化:来自不同数据源的数据格式、时区、货币单位、字段定义往往不一致。在进入数据库前必须经过清洗和标准化处理。一个未被处理的”价格字段混合了美元和英镑”的问题,可能导致整个定价智能体的策略失效。

第三,数据更新频率规划:不同类型的数据需要不同的更新节奏。广告曝光和点击数据需要每小时同步(高决策频率);BSR 榜单数据每 4-6 小时更新一次即可;历史评论数据每天同步一次就足够。提前规划好调度策略,避免 API 配额被无意义的高频请求浪费。

要点四:决策闭环——感知→分析→决策→执行→反馈→迭代

决策闭环是智能体持续进化的核心机制。任何一个缺少反馈和迭代环节的智能体,只能做到”一次性自动化”,而无法实现”越用越聪明”的效果。

以广告智能体为例,完整的闭环是这样运转的:

- 感知:每小时读取广告 API,获取各广告组的曝光/点击/转化/花费数据

- 分析:计算各关键词的 ACoS、ROAS、点击率,识别异常指标并归因

- 决策:LLM 结合规则引擎判断应对策略(降价出价 / 暂停关键词 / 调整匹配方式 / 向预算超支告警)

- 执行:通过广告 API 自动执行出价调整,高金额操作推送人工确认

- 反馈:24 小时后对比操作前后的 ACoS 变化,记录本次操作的效果

- 迭代:将操作效果数据反哺到决策模型的提示词优化中,下次面对相似情境时做出更精准的判断

没有第 5、6 步的智能体,只是一个”高级自动化脚本”,而不是真正意义上的”智能体”。

要点五:合规与风控——操作可审计,风险可拦截

在亚马逊平台上运行 AI 自动化操作,合规风险是必须在设计阶段就纳入考量的约束条件,而不是上线后再来补救的问题。三类主要风控措施:

操作审计日志(Audit Log):智能体的每一次实际操作(修改价格、调整出价、回复评论)都必须产生完整的审计记录,包括触发条件、决策依据、操作内容、执行时间、操作人/系统标识。这不仅是合规要求,也是后续效果评估和问题排查的唯一依据。

操作频率限制(Rate Limiting):设置每类操作的单日执行上限(如”同一 ASIN 的价格每天最多调整 3 次”),防止异常循环逻辑导致不受控的连续操作。所有 API 调用都必须遵守亚马逊官方的请求频率限制,避免触发账号异常。

高风险操作人工拦截:明确定义哪类操作属于”高风险操作”并强制进入人工审核队列。建议将以下操作纳入高风险清单:价格调整幅度超过 15%、删除广告活动或广告组、批量修改 Listing 标题、任何涉及账号权限的操作。

要点六:人机协同——人管战略,机器管执行

智能体的目标不是”完全取代运营团队”,而是重新分配人机职责,让人专注于更高价值的决策,让机器负责高频、重复、低创意性的执行。合理的人机协同边界大致是:

| 责任方 | 职责范围 |

|---|---|

| 人工负责 | 战略目标设定、品牌创意方向、新品定位决策、异常情况研判、高风险操作最终确认 |

| 智能体负责 | 日常数据监控、竞品动态追踪、广告出价优化、库存预警计算、评论回复草稿生成、报表生成 |

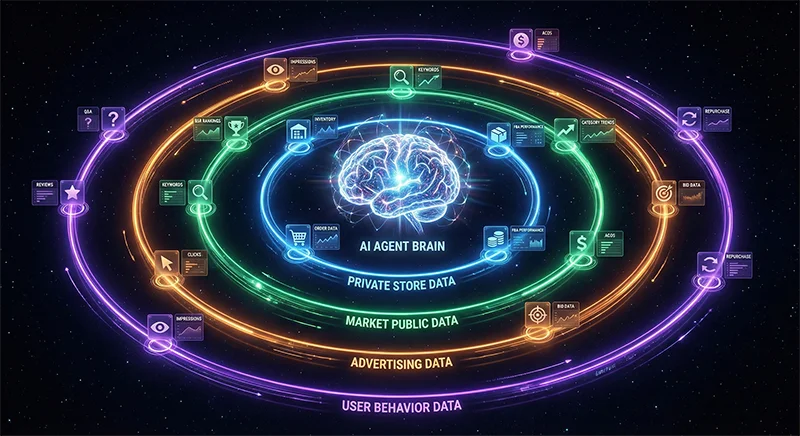

四、数据源:亚马逊运营智能体的核心命脉(重点章节)

如果说技术架构是智能体的骨骼,那么数据源就是智能体的血液。一个在技术架构上设计精妙的智能体,如果没有高质量的数据输入,就如同一台高性能发动机却没有燃料——运转不起来,或者以错误的方向运转。

4.1 智能体必需的四类核心数据

第一类:店铺私有数据(来源:Amazon SP-API)

这是亚马逊通过官方 SP-API 开放给卖家的第一方数据,属于合规性最强、数据精准度最高的数据类型,是所有智能体模块的基础数据层。

核心数据接口清单:

- Orders API:订单详情、买家地址(用于 FBA 区域配置)、退货状态。刷新频率:每小时

- Inventory API:各 ASIN 的 FBA 可用库存量、入仓在途、不可售库存。刷新频率:每 4 小时

- Sales API:按 ASIN 和日期维度的销售数据,用于销量趋势分析。刷新频率:每天

- Seller API(Metrics):账号健康度评分、ODR(缺陷率)、LDR(迟发率)、VTR(正确追踪率)。刷新频率:每天

- Fulfillment Inbound API:FBA 入仓计划状态、入仓进度。刷新频率:每 2 小时

- Finance API:结算数据、FBA 费用明细,用于 SKU 级别利润核算。刷新频率:每周

SP-API 接入的技术要点:需要通过亚马逊 Developer Portal 申请应用权限,完成 OAuth 授权流程,并定期刷新 Access Token(有效期仅 1 小时)。强烈建议封装一个统一的”SP-API 客户端类”统一管理所有接口的认证和重试逻辑。以下是一个 Python 实现的基础示例:

"""

sp_api_client.py — SP-API 基础客户端封装

"""

import requests

import time

from datetime import datetime, timedelta

class SPAPIClient:

"""亚马逊 SP-API 统一客户端,自动处理 Token 刷新"""

TOKEN_ENDPOINT = "https://api.amazon.com/auth/o2/token"

BASE_URL = "https://sellingpartnerapi-na.amazon.com" # 北美区

def __init__(self, client_id: str, client_secret: str, refresh_token: str):

self.client_id = client_id

self.client_secret = client_secret

self.refresh_token = refresh_token

self._access_token = None

self._token_expires_at = None

def _refresh_access_token(self):

"""刷新 Access Token(有效期 1 小时)"""

resp = requests.post(self.TOKEN_ENDPOINT, data={

"grant_type": "refresh_token",

"refresh_token": self.refresh_token,

"client_id": self.client_id,

"client_secret": self.client_secret,

})

resp.raise_for_status()

data = resp.json()

self._access_token = data["access_token"]

# 提前 60 秒刷新,避免临界过期问题

self._token_expires_at = datetime.utcnow() + timedelta(seconds=data["expires_in"] - 60)

@property

def access_token(self) -> str:

if not self._access_token or datetime.utcnow() >= self._token_expires_at:

self._refresh_access_token()

return self._access_token

def get(self, path: str, params: dict = None) -> dict:

"""发送 GET 请求,自动附加认证头,自动重试(最多 3 次)"""

headers = {

"x-amz-access-token": self.access_token,

"Content-Type": "application/json",

}

for attempt in range(3):

try:

resp = requests.get(

f"{self.BASE_URL}{path}",

headers=headers,

params=params,

timeout=15

)

if resp.status_code == 429:

# 触发限流,等待后重试

wait = int(resp.headers.get("Retry-After", 5))

time.sleep(wait)

continue

resp.raise_for_status()

return resp.json()

except requests.RequestException as e:

if attempt == 2:

raise

time.sleep(2 ** attempt)

raise RuntimeError("SP-API 请求失败,已超过最大重试次数")

# ── 使用示例 ──────────────────────────────────────────

if __name__ == "__main__":

client = SPAPIClient(

client_id="amzn1.application-oa2-client.xxx",

client_secret="your_client_secret",

refresh_token="Atzr|xxx"

)

# 获取最近 7 天销售数据

sales = client.get(

path="/sales/v1/orderMetrics",

params={

"marketplaceIds": "ATVPDKIKX0DER", # 美国站 ID

"interval": f"{(datetime.utcnow() - timedelta(days=7)).strftime('%Y-%m-%dT00:00:00Z')}"

f"--{datetime.utcnow().strftime('%Y-%m-%dT00:00:00Z')}",

"granularity": "Day",

}

)

print(f"近7天订单数据:{sales}")

第二类:市场公域数据(需第三方数据服务)

包括 BSR 榜单排名与变化趋势、竞品 ASIN 详情(价格/评论数/评分)、关键词搜索量与竞价水平、类目新品爆发信号、搜索页广告位占位情况。

这类数据亚马逊并未通过官方 API 提供(或提供的维度非常有限),因此需要通过专业的第三方数据采集服务来获取。这正是 数据源决定智能体成败 的关键所在——没有可靠的市场公域数据,选品智能体无法识别机会,竞品监控智能体无从运行,广告智能体也无法评估关键词的真实竞争态势。

第三类:广告数据(来源:Amazon Advertising API)

亚马逊广告 API 独立于 SP-API,需要单独申请权限(通过亚马逊广告平台 Console)。核心数据接口包括:

- Campaigns API:广告活动列表、预算、状态

- Ad Groups API:广告组配置、出价策略

- Keywords API:关键词级别的曝光/点击/转化/花费数据

- Reports API(异步):生成广告报告,通过轮询获取报告下载链接

注意:广告 Reports API 是异步接口,请求后需轮询报告状态,通常需要 10-30 分钟才能完成。建议使用消息队列(如 Redis Streams 或 SQS)管理报告生成任务,避免阻塞主流程。

第四类:用户行为数据(评论/Q&A)

包括各 ASIN 的历史评论(评分分布、情感关键词、常见投诉点)、买家 Q&A、退货原因(通过 Orders API 部分可得)。这类数据是 Listing 优化智能体和客服智能体的核心输入,决定了智能体能否真正理解”用户为什么满意或不满意”。

4.2 为什么数据源决定智能体成败

原因一:数据是智能体的感知器官

智能体对亚马逊市场的所有”感知”,都来自数据。没有数据,智能体就像一个蒙着眼睛的运营员——即便它推理能力再强,也无法做出有价值的判断。一个无法感知竞品价格变化的广告智能体,会在竞品大幅降价时继续保持原有出价策略,最终导致广告预算被低效消耗。

原因二:数据质量直接决定决策精度

智能体基于数据做决策,数据质量误差会被决策模型放大。如果 BSR 数据存在 24 小时延迟,智能体识别到的”榜单爆发信号”可能已经是过期信息,基于此做出的补货决策就会滞后;如果评论情感分析使用的是脏数据(含大量刷评),智能体对产品真实用户反馈的判断就会系统性偏差。

原因三:数据是模型训练与迭代的唯一燃料

智能体的”越用越聪明”,本质上依赖于历史操作数据与结果反馈数据的积累。智能体在某次广告优化中做出的决策,以及这个决策 72 小时后带来的 ACoS 变化,都需要被完整记录在数据库里,成为下一轮提示词优化和策略调整的依据。没有数据积累,就没有迭代进化的可能。

原因四:数据是亚马逊流量逻辑的唯一映射

亚马逊的所有运营核心逻辑——关键词排名是如何被计算的?广告质量得分如何影响位置?评论数和评分如何影响转化率?——都只能通过数据来反向推断和映射。没有对这些数据的持续观察和分析,智能体的决策就缺乏亚马逊平台特有的”运营直觉”。

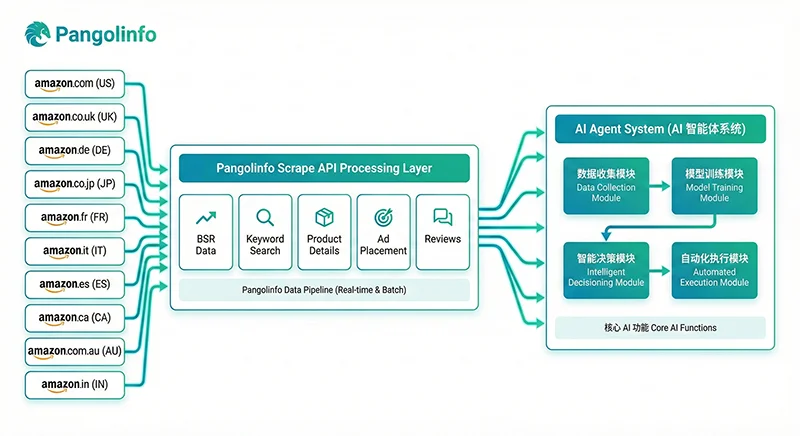

4.3 市场公域数据的接入方案:Pangolinfo Scrape API

在四类数据源中,市场公域数据(第二类)的获取是技术挑战最大的环节。亚马逊没有提供这类数据的官方 API,直接爬取亚马逊页面面临严格的反爬机制,而且需要为每个站点单独开发和维护解析逻辑。

Pangolinfo Scrape API 覆盖亚马逊全球 20+ 站点,对关键数据类型维护专属的解析模板,输出统一的 JSON 格式——这意味着无论你需要的是美国站还是德国站的数据,API 响应的字段结构完全一致,极大降低了多站点数据管道的开发和维护成本。

对亚马逊运营智能体而言,可以通过 Pangolinfo Scrape API 获取以下核心数据类型:

| 数据类型 | 用途场景 | 建议更新频率 |

|---|---|---|

| 类目 BSR 榜单 Top 100 | 市场机会扫描、爆品信号识别 | 每 4-6 小时 |

| 竞品 ASIN 商品详情 | 竞品价格/评论/评分监控 | 每 2-4 小时 |

| 关键词搜索结果页 | 关键词排名追踪、自然位监控 | 每天 |

| SP广告位数据 | 广告竞争态势分析(行业98%采集率) | 每 4 小时 |

| 评论数据 | 竞品差评分析、情感趋势监控 | 每天 |

| 新品榜单(New Releases) | 新品爆发预警、蓝海机会识别 | 每 6 小时 |

以下是一个完整的 Pangolinfo API 调用示例,演示如何将竞品监控数据接入运营智能体:

"""

pangolinfo_data_collector.py

将 Pangolinfo Scrape API 集成进亚马逊运营智能体的数据采集模块

"""

import requests

import json

import time

from datetime import datetime, timezone

from dataclasses import dataclass

from typing import Optional

PANGOLINFO_API_KEY = "your_pangolinfo_api_key"

API_BASE = "https://api.pangolinfo.com/v1/amazon"

HEADERS = {

"Authorization": f"Bearer {PANGOLINFO_API_KEY}",

"Content-Type": "application/json"

}

@dataclass

class CompetitorSnapshot:

"""竞品监控快照数据模型"""

asin: str

marketplace: str

title: str

price: float

currency: str

rating: float

review_count: int

bsr_rank: Optional[int]

bsr_category: Optional[str]

availability: str

fetched_at: str

def fetch_competitor_detail(asin: str, marketplace: str = "amazon.com") -> Optional[CompetitorSnapshot]:

"""

获取竞品 ASIN 的实时详情数据

用于竞品监控智能体的感知层

"""

payload = {

"marketplace": marketplace,

"type": "product_detail",

"asin": asin

}

for attempt in range(3):

try:

resp = requests.post(

f"{API_BASE}/product",

headers=HEADERS,

json=payload,

timeout=30

)

resp.raise_for_status()

data = resp.json()

product = data.get("product", {})

bsr = product.get("bestseller_ranks", [{}])[0] if product.get("bestseller_ranks") else {}

return CompetitorSnapshot(

asin=asin,

marketplace=marketplace,

title=product.get("title", "")[:120],

price=float(product.get("price", 0) or 0),

currency=product.get("currency", "USD"),

rating=float(product.get("rating", 0) or 0),

review_count=int(product.get("review_count", 0) or 0),

bsr_rank=bsr.get("rank"),

bsr_category=bsr.get("category"),

availability=product.get("availability", "unknown"),

fetched_at=datetime.now(timezone.utc).isoformat()

)

except requests.HTTPError as e:

if e.response.status_code == 429:

time.sleep(2 ** attempt + 1)

else:

print(f"[ERROR] HTTP {e.response.status_code} for ASIN {asin}: {e}")

return None

except Exception as e:

print(f"[ERROR] {type(e).__name__} for {asin}: {e}")

return None

return None

def fetch_category_bsr_top20(category_node: str, marketplace: str = "amazon.com") -> list[dict]:

"""

获取类目 BSR Top 20 数据

用于选品智能体的市场扫描

"""

payload = {

"marketplace": marketplace,

"type": "bestsellers",

"category_id": category_node,

"limit": 20

}

try:

resp = requests.post(

f"{API_BASE}/category/bestsellers",

headers=HEADERS,

json=payload,

timeout=30

)

resp.raise_for_status()

return resp.json().get("products", [])

except Exception as e:

print(f"[ERROR] BSR fetch failed: {e}")

return []

def monitor_competitor_price_change(

asin: str,

previous_price: float,

threshold_pct: float = 0.05,

marketplace: str = "amazon.com"

) -> dict:

"""

竞品价格异动检测

如果价格变化超过阈值,触发预警

Returns:

dict 包含 is_alert, change_pct, current_price, action_suggestion

"""

snapshot = fetch_competitor_detail(asin, marketplace)

if not snapshot:

return {"is_alert": False, "error": "数据获取失败"}

if previous_price <= 0:

return {"is_alert": False, "current_price": snapshot.price, "message": "首次采集,无变化基准"}

change_pct = (snapshot.price - previous_price) / previous_price

result = {

"asin": asin,

"marketplace": marketplace,

"previous_price": previous_price,

"current_price": snapshot.price,

"change_pct": round(change_pct * 100, 2),

"review_count": snapshot.review_count,

"rating": snapshot.rating,

"bsr_rank": snapshot.bsr_rank,

"is_alert": abs(change_pct) >= threshold_pct,

"fetched_at": snapshot.fetched_at

}

if result["is_alert"]:

direction = "降价" if change_pct < 0 else "涨价"

result["action_suggestion"] = (

f"竞品 {asin} {direction} {abs(result['change_pct'])}%,"

f"当前价格 ${snapshot.price:.2f}。"

f"建议评估自身定价策略,必要时启动价格调整流程。"

)

return result

# ── 批量竞品监控入口 ─────────────────────────────────────────────

def run_competitor_monitoring(watchlist: list[dict]) -> list[dict]:

"""

批量处理竞品监控列表

watchlist: [{"asin": "B08XY1234", "last_price": 29.99, "marketplace": "amazon.com"}, ...]

"""

alerts = []

for item in watchlist:

result = monitor_competitor_price_change(

asin=item["asin"],

previous_price=item.get("last_price", 0),

marketplace=item.get("marketplace", "amazon.com")

)

if result.get("is_alert"):

alerts.append(result)

print(f"⚠️ 价格预警:{result['action_suggestion']}")

else:

print(f"✅ {item['asin']} 价格稳定(当前 ${result.get('current_price', 'N/A')})")

time.sleep(0.5) # 避免请求过于密集

return alerts

if __name__ == "__main__":

# 示例:监控 3 个核心竞品

COMPETITOR_WATCHLIST = [

{"asin": "B08XY12345", "last_price": 29.99, "marketplace": "amazon.com"},

{"asin": "B09AB67890", "last_price": 34.50, "marketplace": "amazon.com"},

{"asin": "B07CD24680", "last_price": 27.00, "marketplace": "amazon.co.uk"},

]

print("=== 开始竞品监控巡检 ===")

alerts = run_competitor_monitoring(COMPETITOR_WATCHLIST)

print(f"\n本次巡检触发预警 {len(alerts)} 条,已写入告警队列。")

4.4 数据缺失与劣质数据的致命风险

在规划亚马逊运营智能体时,必须对以下几类数据风险有清醒认识:

风险一:选品智能体误判市场机会。如果 BSR 数据存在18小时延迟,智能体识别到的”新品榜单爆发”可能已经是昨天的信号,当你的智能体触发”加速铺货”操作时,市场竞争已经进入下一阶段。

风险二:广告智能体在错误信号上浪费预算。如果广告数据中存在异常的无效点击(ABA 数据污染),智能体会把高点击率误判为优质关键词,持续加大出价,最终导致广告费用飙升而转化率不升。

风险三:Listing 合规智能体漏报侵权风险。如果竞品数据库不完整(缺少新入场的专利持有竞品),合规智能体就无法预警”与新竞品的侵权冲突风险”,可能导致 Listing 被投诉下架。

解决之道:在智能体设计阶段就建立数据质量监控层,对关键数据流的延迟、缺失率、异常值进行持续监控,并在数据质量低于设定阈值时自动降级智能体的置信度(从”自动执行”切换到”提交人工审核”模式)。

五、亚马逊运营智能体全链路落地实施路径

理论框架和代码示例都有了,接下来是最关键的问题:如何从零开始,一步步把智能体真正跑起来?我们把落地实施拆分为六个递进阶段。

第一阶段:需求梳理与场景定义(建议用时:1-2 周)

在写任何代码之前,先做好三件准备:

① 核心场景锁定:聚焦 MVP,选定最高优先级的 1-2 个场景。建议的首期选择排序:

- 广告 ACoS 监控 + 自动出价调整(ROI 最清晰,可量化)

- 竞品价格监控 + 价格联动预警(逻辑相对简单,效果感知快)

- 差评/Q&A 监控 + 回复草稿生成(操作量大,LLM 直接发挥)

② SOP 文档化:把你现有的人工操作 SOP 整理成结构化文档——智能体的提示词工程和规则引擎设计,都需要以这些 SOP 为蓝本。如果连人工 SOP 都没有,智能体的行为就没有基准可参照。

③ 成功指标定义:明确每个场景的”成功条件”。例如广告智能体的成功标准可以是:在 4 周内将目标广告组 ACoS 从 22% 降低至 15% 以下,每周节省广告优化人力超过 8 小时。没有量化目标,智能体的效果就无法评估。

第二阶段:数据基础设施搭建(建议用时:2-3 周)

这是 80% 的团队最容易跳过、但实际上决定后续所有环节成败的阶段。

① SP-API 接入与认证流程

注册步骤:进入 Amazon Seller Central Developer Portal → 创建开发者账号 → 创建应用 → 获取 Client ID / Client Secret → 完成 OAuth 授权获取 Refresh Token。用上一章节提供的 SPAPIClient 类完成封装。

② 广告 API 独立授权

访问 Amazon Advertising Console → 申请 API 访问 → 创建广告 API Profile → 完成独立授权流程(注意:广告 API 授权流程与 SP-API 相互独立,需要分开处理)。

③ Pangolinfo API 接入(市场公域数据)

访问 Pangolinfo 控制台 → 注册账号 → 创建 API Key → 配置目标站点和数据类型 → 用上一章节提供的采集模块完成集成。建议首先配置竞品 ASIN 详情和类目 BSR 榜单两类数据,验证数据质量后再扩展其他类型。

④ 数据库搭建

最小化的数据库方案:PostgreSQL(结构化运营数据)+ Redis(热点缓存和任务队列)+ 一个向量数据库(PGVector 或 Weaviate,用于 RAG 检索增强智能体记忆)。以下是核心数据库表结构:

-- 竞品价格历史表

CREATE TABLE competitor_price_history (

id BIGSERIAL PRIMARY KEY,

asin VARCHAR(20) NOT NULL,

marketplace VARCHAR(20) NOT NULL,

price NUMERIC(10,2),

rating NUMERIC(3,2),

review_count INTEGER,

bsr_rank INTEGER,

fetched_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE INDEX idx_competitor_asin_time ON competitor_price_history(asin, fetched_at DESC);

-- 广告操作日志表(智能体审计核心)

CREATE TABLE ad_agent_operation_log (

id BIGSERIAL PRIMARY KEY,

operation_type VARCHAR(50) NOT NULL, -- bid_adjust / pause_keyword / budget_change

campaign_id VARCHAR(50),

ad_group_id VARCHAR(50),

keyword_id VARCHAR(50),

before_value JSONB,

after_value JSONB,

trigger_reason TEXT,

llm_reasoning TEXT, -- LLM 的决策推理过程(可审计)

execution_mode VARCHAR(20), -- auto / human_required

executed_by VARCHAR(50), -- agent_v1 / human:alice

executed_at TIMESTAMPTZ DEFAULT NOW(),

result_acos NUMERIC(5,2), -- 72小时后回填,用于效果评估

result_checked_at TIMESTAMPTZ

);

-- 智能体任务调度表

CREATE TABLE agent_task_queue (

id BIGSERIAL PRIMARY KEY,

agent_type VARCHAR(50) NOT NULL,

task_params JSONB,

priority SMALLINT DEFAULT 5,

status VARCHAR(20) DEFAULT 'pending',

created_at TIMESTAMPTZ DEFAULT NOW(),

started_at TIMESTAMPTZ,

finished_at TIMESTAMPTZ,

error_message TEXT

);

第三阶段:MVP 开发(建议用时:3-5 周)

以”广告 ACoS 监控智能体”为例,演示完整的 MVP 开发流程:

"""

ad_acos_agent.py — 广告 ACoS 监控智能体 MVP 版本

功能:每小时获取广告数据 → 计算 ACoS → LLM 生成优化策略 → 自动执行或推送人工审核

"""

import os, json

from datetime import datetime, timezone

import anthropic

ANTHROPIC_API_KEY = os.getenv("ANTHROPIC_API_KEY")

ACOS_ALERT_THRESHOLD = 0.20

ACOS_TARGET = 0.15

def compute_keyword_acos(ad_data: list[dict]) -> list[dict]:

analyzed = []

for kw in ad_data:

spend = float(kw.get("spend") or 0)

sales = float(kw.get("attributedSales30d") or 0)

clicks = int(kw.get("clicks") or 0)

impressions = int(kw.get("impressions") or 0)

acos = (spend / sales) if sales > 0 else 99.0

analyzed.append({

"keyword": kw.get("keywordText"),

"keyword_id": kw.get("keywordId"),

"spend": spend, "sales": sales,

"acos": round(acos, 4),

"ctr": round(clicks / impressions, 4) if impressions else 0,

"is_alert": acos > ACOS_ALERT_THRESHOLD and spend > 5.0,

})

return analyzed

def generate_optimization_strategy(keyword_data: list[dict]) -> dict:

client = anthropic.Anthropic(api_key=ANTHROPIC_API_KEY)

alert_items = [k for k in keyword_data if k["is_alert"]]

if not alert_items:

return {"actions": [], "summary": "所有关键词 ACoS 均在目标范围内,无需调整。"}

prompt = f"""你是亚马逊广告优化专家。分析以下超过目标 ACoS({ACOS_TARGET*100:.0f}%)的关键词,给出操作建议。

数据:{json.dumps(alert_items, ensure_ascii=False)}

按如下 JSON 格式输出,只输出 JSON:

{{"actions":[{{"keyword":"..","keyword_id":"..","action":"reduce_bid|pause|add_negative",

"current_bid_adjustment_pct":-15,"reasoning":"..","confidence":0.85,"risk_level":"low|medium|high"}}],

"summary":"总结"}}"""

resp = client.messages.create(model="claude-3-5-sonnet-20241022", max_tokens=1500,

messages=[{"role": "user", "content": prompt}])

try:

return json.loads(resp.content[0].text)

except Exception:

return {"actions": [], "summary": "LLM 解析失败,请人工复核。"}

def execute_ad_operations(strategy: dict, dry_run: bool = True) -> list[dict]:

results = []

for action in strategy.get("actions", []):

risk = action.get("risk_level", "medium")

confidence = action.get("confidence", 0)

needs_human = risk == "high" or confidence < 0.70

mode = "human_required" if needs_human else "auto"

if needs_human:

print(f"⚠️ [人工审核] {action['keyword']}: {action['action']} (置信度{confidence:.0%})")

elif not dry_run:

print(f"✅ [自动执行] {action['keyword']}: {action['action']} {action.get('current_bid_adjustment_pct',0):+d}%")

else:

print(f"🔍 [模拟模式] {action['keyword']}: {action['action']} {action.get('current_bid_adjustment_pct',0):+d}%")

results.append({"keyword": action.get("keyword"), "action": action.get("action"),

"execution_mode": mode, "dry_run": dry_run,

"executed_at": datetime.now(timezone.utc).isoformat()})

return results

def run_acos_agent_cycle(ad_report_data: list[dict]) -> dict:

print(f"\n[{datetime.now().strftime('%H:%M')}] ACoS 智能体运行中...")

analysis = compute_keyword_acos(ad_report_data)

alerts = sum(1 for k in analysis if k["is_alert"])

strategy = generate_optimization_strategy(analysis)

exec_log = execute_ad_operations(strategy, dry_run=True) # 上线观察2周后改为False

return {"keywords_analyzed": len(analysis), "alerts": alerts,

"summary": strategy.get("summary"), "execution_log": exec_log}

第四阶段:测试验证(建议用时:2-3 周)

① 数据质量验证(第1-3天):核心字段缺失率目标 < 2%,数据延迟在设计规格内。

② 规则引擎回测(第4-7天):用过去 30 天历史数据验证决策逻辑,与人工决策对比,优化不一致案例。

③ Dry Run 真实环境测试(第8-14天):接入真实数据流,每日发运营团队复核。误报率目标 < 20%,漏报率目标 < 10%。

④ 小范围灰度生产(第3周):选取5-10个低风险广告组开启 auto 模式,其余保持人工作为对照组,对比2周效果。

第五阶段:迭代优化(持续进行)

根据 Dry Run 阶段的”错误决策案例”持续优化提示词;每月复盘规则阈值是否需要根据季节或品类调整;建立”操作→72小时→记录效果→写回知识库”的标准化反馈流程。

第六阶段:规模化运营(上线稳定 1 个月后)

- 扩展全量广告组 auto 模式

- 上线竞品监控智能体(接入 Pangolinfo BSR + 商品详情)

- 上线库存预警智能体(SP-API 库存数据 + 销量趋势模型)

- 上线评论管理智能体(评论 API + LLM 回复生成)

- 多智能体协同:广告 ↔ 价格 ↔ 库存 事件触发联动

六、实战案例与效果量化

案例一:广告 ACoS 优化智能体

背景:某3C品牌,美国站,120个广告活动,日均花费 $1,200,团队每天4小时处理广告,ACoS 长期在 20-22%。

方案:广告 Reports API + 规则引擎 + Claude 3.5,每小时 ACoS 监控 + 关键词级别自动出价调整。

结果(6周后):

- 整体 ACoS 从 21.8% 降至 14.2%,降幅 35%

- 广告转化率提升 18%(差关键词被及时暂停,预算集中于高转化词)

- 每周广告优化人力从 28 小时降至 6 小时

案例二:评论管理与差评响应智能体

背景:某家居品牌,8个亚马逊站点,SKU约200个,每天40-80条新评论,要求24小时差评响应。

方案:Pangolinfo API 实时获取新评论 + LLM 情感分析 + 个性化回复草稿生成 + 高风险差评触发人工处理。

结果(8周后):

- 差评响应时效从平均 18 小时缩短至 2.4 小时

- 综合评分从 4.1 提升至 4.4

- 评论管理人力从每周 15 小时降至 3 小时

- 回复草稿采用率 78%

案例三:竞品监控 + 选品机会发现智能体

背景:某品牌运营美国、英国、德国三站点,Q2 需要识别蓝海类目机会。

方案:Pangolinfo API 每4小时采集目标类目 BSR Top 50 + 竞品评论数 + 新品榜单,自动计算”竞争密度指数”和”机会得分”。

结果(10周后):

- 识别出德国站某子类目竞争密度仅为美国站 1/8(Top 20均评论数 280 vs 2300)

- 新品调研周期从4周缩短至1周

- 首发德国站的新品3个月内 BSR 进入前50,同品美国站同期未进前200

七、挑战与未来趋势

7.1 当前核心挑战

挑战一:API 权限限制与数据空白。部分高价值数据(如精准关键词搜索量、竞品广告策略)官方不开放,智能体能力受制于数据可得性,需以第三方数据补充。

挑战二:大模型推理的不确定性。LLM 输出有一定随机性,高确定性场景(合规审核、风险判断)必须结合规则引擎,不能纯依赖 LLM 决策。

挑战三:初期投入产出比管理预期。智能体建设前3个月以基础设施为主,ROI 受限。需提前对齐管理层预期,以月为单位评估价值而非以周。

挑战四:合规边界的动态变化。亚马逊政策持续更新,依赖特定操作路径的智能体需要持续适配,团队需建立政策变化监控机制。

7.2 未来趋势

趋势一:多智能体协同。广告 ACoS 上升→触发价格智能体评估调价→触发库存智能体评估可售库存→协同制定综合策略。事件驱动的多智能体协同将成为下一阶段主流范式。

趋势二:亚马逊 Rufus 生态融合。Rufus AI 购物助手已开始影响搜索行为,未来 Listing 优化智能体需理解”如何在 Rufus 推荐中获得优先位置”,AEO 与传统 SEO 需协同。

趋势三:SP-API 数据能力持续扩展。Listing Items API、A+ Content API 等陆续开放,官方数据渠道扩充将逐步减少对第三方采集的依赖,同时要求团队持续跟踪并集成新能力。

八、结论与实施建议

8.1 核心结论

亚马逊运营智能体 = 场景化设计(前提)× 技术架构(骨架)× 高质量数据源(血液)× 决策闭环(灵魂)

四个要素缺一不可,优先级明确:先建数据基础设施,再做场景 MVP,最后规模化扩展。没有高质量数据的智能体,再好的模型也只是”高档的数据处理错误放大器”。

8.2 分角色实施建议

对于亚马逊卖家/运营负责人:

- 先做”数据基础设施盘点”:SP-API 接入了哪些?第三方数据覆盖哪些站点?更新频率是否满足决策需求?

- 选定”高重复、高价值、低风险”的 MVP 场景,设定4-6周验证周期和可量化成功标准

- 在 Dry Run 阶段充分积累操作数据和反馈数据,不要急于切换自动执行模式

- 接受”智能体建设是6-12个月中期投资”这一现实

对于 AI 产品/技术开发者:

- 优先建设数据底座(SP-API + 广告 API + Pangolinfo 市场数据)

- 四层架构(感知/推理/记忆/执行)是生产可用智能体的标准范式,不要绕过

- 操作日志和审计机制必须第一天就设计进去

- 推荐技术栈:Python + FastAPI + PostgreSQL + Redis + Claude 3.5/Gemini 1.5 Pro + LangChain/LlamaIndex

8.3 数据接入快速入口

- SP-API(亚马逊官方):developer.amazonservices.com

- 广告 API(亚马逊官方):advertising.amazon.com/API/docs

- Pangolinfo Scrape API(市场公域数据,20+站点):pangolinfo.com/zh/scraping-api/

- Pangolinfo 文档中心:docs.pangolinfo.com

- 免费试用控制台:tool.pangolinfo.com

- AMZ Data Tracker(无代码方案):pangolinfo.com/zh/amz-data-tracker-2/

开始搭建你的亚马逊运营智能体

数据底座是第一步。立即访问 Pangolinfo Scrape API,以最低接入成本获得覆盖 20+ 亚马逊站点的高质量市场公域数据,为你的运营智能体提供”看清市场”的能力。