当你的电商数据需求遇上Node.js技术栈

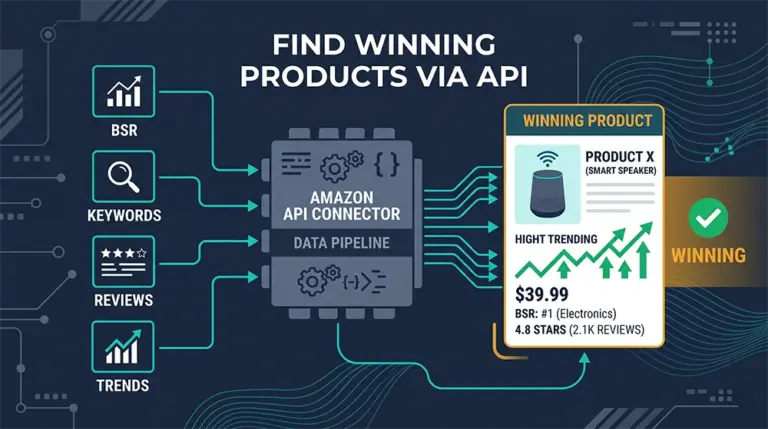

你的团队已经构建好完整的Node.js后端服务,TypeScript覆盖率超过90%,CI/CD流水线稳定运行。直到产品经理提出那个”简单”的需求:每天定时采集竞品的亚马逊价格、榜单排名和评论数据,输入到数据分析系统中。

你开始评估方案。自建爬虫?亚马逊的反爬策略每隔几周就会更新,维护成本不可低估。上个月同事花了三天时间修复因User-Agent变更导致的批量采集失败,那次事故直接影响了月度选品报告的按时交付。买SaaS工具?对于只需要原始数据流的后端系统,那些可视化Dashboard功能完全是多余的付费项,更关键的是这类工具根本不提供程序化接口,无法融入现有数据管道。

真正符合后端开发者需求的,是一套能通过标准HTTP调用、返回结构化JSON、同时具备TypeScript友好接口的数据采集API。本文将完整演示如何进行Node.js Pangolinfo API集成,从零搭建一个生产可用的TypeScript数据采集客户端。

为什么TypeScript是后端数据采集的最佳选择

在讨论具体的Node.js Pangolinfo API集成实现之前,有必要澄清一个常见误区:很多团队在技术选型时会考虑用Python替代Node.js做数据采集,原因是Python的数据处理生态更成熟。这个判断在离线批处理场景下或许成立,但当数据采集需要深度集成于已有Node.js微服务体系、并与实时业务逻辑紧密交互时,维护两套技术栈的复杂度远超收益。

TypeScript在这个场景中提供了三个关键价值。第一是类型安全:API响应结构一旦定义为TypeScript接口,IDE会在你访问不存在字段时立即报错,这比在运行时发现JSON解析问题早数小时乃至数天。电商数据字段结构复杂——亚马逊商品详情页的解析结果可能包含数十个字段,部分字段在不同品类下是可选的(optional),TypeScript的类型系统能精确建模这种不确定性。第二是重构友好:当API升级响应格式时,TypeScript类型检查会帮你定位所有受影响的代码路径,而不是等到线上告警才发现问题。第三是开发体验:async/await语法配合TypeScript的Promise类型推断,让异步数据流代码读起来和同步代码一样清晰。

自建爬虫的隐性成本

许多团队低估了自建爬虫的长期维护成本。一个用Puppeteer或Playwright实现的亚马逊爬虫,初始开发只需一两周,但亚马逊平均每6-8周会有一次反爬策略升级,每次都可能造成数据断流。对于日均百万级请求的采集任务,还需要自行管理代理IP池(成本通常在$200-$800/月),处理验证码识别(平均失败率8-15%),以及维护分布式调度系统。综合计算,工程团队每年用于维护自建爬虫的时间成本折合为工资,往往远超直接使用专业数据采集API的订阅费用。

从工程现实来看,越来越多构建SaaS选品工具、价格监控系统、AI训练数据管道的团队,将后端数据采集方案的核心诉求锁定在:标准化API接口、结构化输出、可预期的SLA、以及与现有技术栈的无缝集成。TypeScript数据采集配合专业API,正是这一诉求的最优解。

三种后端数据采集方案的优劣权衡

对于有Node.js技术背景的团队,常见的电商数据获取路线大致分为三种,各有其适用边界。

| 方案 | 初始成本 | 维护负担 | 数据稳定性 | TypeScript支持 | 适用规模 |

|---|---|---|---|---|---|

| 自建Puppeteer爬虫 | 低(工时成本) | 极高(持续对抗反爬) | 不稳定(依赖页面结构) | 需自行定义 | 小于10万次/天 |

| SaaS选品工具 | 高($300-$1000/月) | 无 | 较稳定 | 不支持程序化调用 | 适合手动查询 |

| Pangolinfo Scrape API | 中(按量计费) | 极低(专业团队维护) | 高(SLA保障) | 标准REST+自定义类型 | 千万级/天 |

对于需要将数据采集能力嵌入后端服务的团队,专业数据采集API是唯一在工程成本、数据稳定性和规模弹性上同时达标的方案。剩下的问题,是如何用TypeScript把这个集成做漂亮。

Pangolinfo Scrape API:为程序化调用而生的数据采集接口

Pangolinfo Scrape API 是一套面向开发者设计的电商数据采集接口,支持亚马逊、沃尔玛、Shopify等主流平台的实时数据采集,输出格式涵盖JSON、原始HTML和Markdown,完全契合Node.js Pangolinfo API集成的工程需求。

在数据覆盖方面,API支持亚马逊商品详情、Best Sellers榜单、New Releases新品榜、关键词搜索结果、广告位数据(SP广告位采集率行业领先,达98%)、评论数据等全品类公开数据的结构化采集。尤其值得关注的是对指定邮区(ZIP Code)采集的支持——不同配送地区的亚马逊价格和库存状态存在显著差异,这一能力对价格监控类应用极有价值。

在工程友好性上,Pangolinfo提供标准RESTful API接口,支持异步任务模式和同步响应模式,响应体为标准JSON结构,天然适合TypeScript接口定义。官方API文档提供了完整的请求参数说明和响应字段描述,开发者可以据此精确建立TypeScript类型定义。

此外,对于有评论数据采集需求的团队,Reviews Scraper API提供了专门针对评论场景优化的采集接口,支持完整的Customer Says抓取,为构建评论情感分析管道提供了可靠的数据基础。

环境搭建:15分钟完成配置

开始Pangolinfo Node.js开发教程的实践部分,确保本地环境满足:Node.js 18.x或更高版本(推荐LTS版本),npm 9.x或yarn 1.22.x,TypeScript 5.x。

# 初始化项目

mkdir pangolin-data-client && cd pangolin-data-client

npm init -y

# 安装核心依赖

npm install axios dotenv

# 安装开发依赖

npm install -D typescript ts-node @types/node @types/axios

# 初始化TypeScript配置

npx tsc --init配置 tsconfig.json,开启严格模式以获得最佳类型安全:

{

"compilerOptions": {

"target": "ES2022",

"module": "commonjs",

"outDir": "./dist",

"rootDir": "./src",

"strict": true,

"esModuleInterop": true,

"skipLibCheck": true,

"resolveJsonModule": true,

"declaration": true,

"sourceMap": true

},

"include": ["src/**/*"],

"exclude": ["node_modules", "dist"]

}创建 .env 文件,存储API密钥(可在 Pangolinfo控制台 获取):

PANGOLIN_API_KEY=your_api_key_here

PANGOLIN_API_BASE_URL=https://api.pangolinfo.com/v1TypeScript完整实现:从类型定义到生产级客户端

第一步:定义TypeScript接口类型

良好的TypeScript数据采集实践始于精确的类型定义。在 src/types/pangolin.types.ts 中建立完整的类型体系:

// src/types/pangolin.types.ts

/** API统一响应包装结构 */

export interface PangolinApiResponse<T = unknown> {

code: number;

message: string;

data: T;

requestId: string;

creditsUsed: number;

}

/** 亚马逊商品详情数据结构 */

export interface AmazonProductDetail {

asin: string;

title: string;

brand: string;

price: number;

currency: string;

originalPrice?: number;

rating: number;

reviewCount: number;

bsr: number;

bsrCategory: string;

availability: 'InStock' | 'OutOfStock' | 'Limited' | string;

images: string[];

bulletPoints: string[];

fulfillment: 'FBA' | 'FBM' | string;

deliveryInfo?: string;

}

/** 亚马逊搜索结果单条商品 */

export interface AmazonSearchProduct {

asin: string;

title: string;

price: number;

currency: string;

rating: number;

reviewCount: number;

isPrime: boolean;

isSponsored: boolean;

position: number;

}

/** 错误重试配置 */

export interface RetryConfig {

maxRetries: number; // 最大重试次数,默认3次

baseDelay: number; // 初始重试延迟(毫秒),默认1000ms

backoffFactor: number; // 退避指数,默认2(指数退避)

maxDelay: number; // 最大延迟上限(毫秒),默认30000ms

retryStatusCodes: number[]; // 触发重试的HTTP状态码

}第二步:实现带指数退避重试的核心客户端

在 src/client/PangolinClient.ts 中实现生产级客户端。采用指数退避(Exponential Backoff)算法处理限流和临时性错误,这是所有严肃后端数据采集方案的标准实践:

// src/client/PangolinClient.ts

import axios, { AxiosInstance, AxiosError } from 'axios';

import * as dotenv from 'dotenv';

import {

PangolinApiResponse,

AmazonProductDetail,

AmazonSearchProduct,

RetryConfig,

} from '../types/pangolin.types';

dotenv.config();

export class PangolinClient {

private readonly http: AxiosInstance;

private readonly retryConfig: RetryConfig;

constructor(apiKey?: string, retryConfig: Partial<RetryConfig> = {}) {

const key = apiKey ?? process.env.PANGOLIN_API_KEY;

if (!key) {

throw new Error('[PangolinClient] API Key未配置。请设置PANGOLIN_API_KEY环境变量。');

}

this.http = axios.create({

baseURL: process.env.PANGOLIN_API_BASE_URL ?? 'https://api.pangolinfo.com/v1',

headers: {

'Authorization': `Bearer ${key}`,

'Content-Type': 'application/json',

},

timeout: 60_000,

});

// 请求/响应拦截器,记录日志

this.http.interceptors.request.use((config) => {

console.log(`[Pangolin] → ${config.method?.toUpperCase()} ${config.url}`);

return config;

});

this.http.interceptors.response.use(

(res) => { console.log(`[Pangolin] ← ${res.status}`); return res; },

(err) => Promise.reject(err)

);

this.retryConfig = {

maxRetries: retryConfig.maxRetries ?? 3,

baseDelay: retryConfig.baseDelay ?? 1_000,

backoffFactor: retryConfig.backoffFactor ?? 2,

maxDelay: retryConfig.maxDelay ?? 30_000,

retryStatusCodes: retryConfig.retryStatusCodes ?? [429, 500, 502, 503, 504],

};

}

private sleep(ms: number): Promise<void> {

return new Promise(resolve => setTimeout(resolve, ms));

}

/** 计算指数退避等待时间(含随机抖动,避免惊群效应) */

private calcBackoff(attempt: number): number {

const exp = this.retryConfig.baseDelay * Math.pow(this.retryConfig.backoffFactor, attempt);

const jitter = Math.random() * 500;

return Math.min(exp + jitter, this.retryConfig.maxDelay);

}

private shouldRetry(error: AxiosError, attempt: number): boolean {

if (attempt >= this.retryConfig.maxRetries) return false;

if (!error.response) return true; // 网络错误,始终重试

return this.retryConfig.retryStatusCodes.includes(error.response.status);

}

/** 核心请求方法:带自动重试 */

private async request<T>(endpoint: string, payload: object, attempt = 0): Promise<PangolinApiResponse<T>> {

try {

const res = await this.http.post<PangolinApiResponse<T>>(endpoint, payload);

return res.data;

} catch (err) {

const error = err as AxiosError;

if (this.shouldRetry(error, attempt)) {

const wait = this.calcBackoff(attempt);

console.warn(`[Pangolin] 第${attempt + 1}次重试,等待${(wait / 1000).toFixed(1)}s...`);

await this.sleep(wait);

return this.request<T>(endpoint, payload, attempt + 1);

}

throw new Error(

`[PangolinClient] 请求失败(已重试${attempt}次): ${error.response?.status ?? 'NetworkError'} - ${error.message}`

);

}

}

/** 采集亚马逊商品详情 */

async getAmazonProduct(asin: string, country = 'US', zipCode?: string): Promise<AmazonProductDetail> {

const result = await this.request<AmazonProductDetail>('/scrape', {

url: `https://www.amazon.com/dp/${asin}`,

outputFormat: 'json',

country,

zipCode,

});

return result.data;

}

/** 采集亚马逊关键词搜索结果 */

async searchAmazon(keyword: string, page = 1, country = 'US'): Promise<AmazonSearchProduct[]> {

const url = `https://www.amazon.com/s?k=${encodeURIComponent(keyword)}&page=${page}`;

const result = await this.request<{ products: AmazonSearchProduct[] }>('/scrape', {

url, outputFormat: 'json', country,

});

return result.data.products;

}

/** 批量采集:并发控制 + 进度追踪 */

async batchGetProducts(asins: string[], concurrency = 5): Promise<Map<string, AmazonProductDetail | Error>> {

const results = new Map<string, AmazonProductDetail | Error>();

for (let i = 0; i < asins.length; i += concurrency) {

const chunk = asins.slice(i, i + concurrency);

await Promise.all(chunk.map(async (asin) => {

try {

results.set(asin, await this.getAmazonProduct(asin));

console.log(`[Pangolin] ✓ ${asin} (${results.size}/${asins.length})`);

} catch (e) {

results.set(asin, e as Error);

console.error(`[Pangolin] ✗ ${asin}: ${(e as Error).message}`);

}

}));

if (i + concurrency < asins.length) await this.sleep(200);

}

return results;

}

}第三步:业务层调用示例

// src/index.ts

import { PangolinClient } from './client/PangolinClient';

async function main() {

const client = new PangolinClient(undefined, {

maxRetries: 3, baseDelay: 1_000, backoffFactor: 2,

});

// 示例1:采集单个商品(含指定邮区)

const product = await client.getAmazonProduct('B0BSHF7WHW', 'US', '10001');

console.log(`${product.title} | $${product.price} | BSR #${product.bsr}`);

// 示例2:关键词竞品分析

const products = await client.searchAmazon('wireless earbuds', 1, 'US');

products.slice(0, 5).forEach((p, i) => {

console.log(`${i + 1}. [${p.asin}] $${p.price} ${p.isSponsored ? '[广告]' : ''}`);

});

// 示例3:批量ASIN采集

const batchResults = await client.batchGetProducts(

['B08N5WRWNW', 'B09G9HD6PD', 'B0BZKG3CDZ'], 3

);

console.log(`批量采集完成: ${[...batchResults.values()].filter(v => !(v instanceof Error)).length} 成功`);

}

main().catch(err => { console.error(err.message); process.exit(1); });运行:ts-node src/index.ts

生产环境最佳实践

将上述客户端部署到生产环境时,需重点关注三个方面。一是速率管理:不同API套餐对并发请求数和RPS有不同限制,batchGetProducts的并发数应控制在套餐允许范围内,批次间的200ms延迟可根据实际情况调整。二是可观测性:生产环境建议将console.log替换为pino或winston等结构化日志库,并将每次请求的requestId字段注入日志,方便精准溯源。三是数据落库策略:采集到的数据通常需要持久化,推荐使用事务批量写入数据库,避免频繁单条INSERT带来的性能开销。通过这三点的优化,你的这套后端数据采集方案就具备了企业级的工程可靠性。

总结:用TypeScript把Node.js Pangolinfo API集成做到生产标准

本文展示的TypeScript客户端,涵盖了Node.js Pangolinfo API集成的完整工程实践:精确的接口类型定义消除了运行时数据解析风险;指数退避重试机制在遭遇限流或临时网络异常时自动恢复;并发批量采集在效率与稳定性之间取得平衡;请求/响应拦截器提供了可扩展的日志与监控切入点。

TypeScript数据采集相较于普通JavaScript的核心优势,在于将大量潜在错误从运行时提前到编译期——这在数据管道中尤为关键,因为一个字段名的拼写错误可能导致下游分析数据的系统性偏差。对于正在构建电商数据基础设施的后端团队,这套实践方案从第一天起就能在工程代码质量和系统稳定性上为你提供有力的保障。

立即访问 Pangolinfo Scrape API 开始免费试用,配合 官方文档 完善你的类型定义,在15分钟内完成首次Node.js Pangolinfo API集成调用验证。

立即接入 Pangolinfo Scrape API,用TypeScript构建你的生产级电商数据采集服务。