一个让CTO在凌晨四点发脾气的夜晚

那是2024年11月的一个周三深夜,某头部亚马逊工具平台的CTO赵明(化名)盯着告警大屏,屏幕上密密麻麻的红色错误日志像浪潮一样滚动。他们的核心产品——一个为卖家提供实时竞品价格和广告位监控的SaaS系统——已经连续17个小时无法正常返回数据。那一夜,客服群里炸了锅,三家大客户扬言要退款,技术团队在四个不同的城市同时开着视频会,没有一个人知道问题出在哪。

这不是偶发事件。彼时他们运营着大约200个自建爬虫节点,每天的”工作”有将近40%花在跟亚马逊的反爬系统周旋:换IP、改User-Agent、调频率、处理CAPTCHA。每逢亚马逊更新反爬策略(平均每季度一次大规模更新),整个数据团队就要进入”战时状态”,短则三天,长则两周,核心业务数据会出现不同程度的延迟甚至断更。

到2024年年底,这家公司的工具平台已经服务超过3.2万名注册卖家,付费转化率接近18%,月均ARR超过800万元。数据能力是他们产品的核心护城河,但这道护城河正在以肉眼可见的速度渗漏——不是竞争对手攻破的,是自己的基础设施撑不住压力。

这家公司的数据采集之困,在行业里其实相当普遍。只不过他们的规模足够大、痛点足够具体,最终成为我们在这篇客户成功案例里要深度解析的对象。

三层技术债务:为什么自建爬虫走到了尽头

在这个客户成功案例的背景里,有必要先把问题讲清楚。这家工具公司不是技术能力差,恰恰相反——他们的工程团队有将近30人,其中有专职负责爬虫维护的7名工程师,另有2人负责IP资源的采购和调度。问题在于,他们遇到的是一道系统性的效率天花板,而不是某个可以被打补丁修复的Bug。

第一层困境:反爬对抗的无底洞成本。亚马逊的反爬体系在过去两年里发生了根本性的变化。2023年之前,常规的IP轮换配合合理的请求间隔基本够用;但2024年起,亚马逊开始大规模启用行为指纹识别和会话连续性验证,单纯换IP已经无法绕过。该公司工程团队测算过,维持现有采集规模(月均约80万条有效数据),每月需要消耗约1.2万美金的IP资源,加上工程师人力折算,单条数据的综合采集成本约为0.021元。听起来不高,但当业务增长要求将采集量提升5-10倍时,这个数字的乘积就变得相当可观。

第二层困境:广告位数据的系统性缺失。他们的产品里有一个核心功能:实时监控竞品的SP广告位排名和投放状态。这个功能是付费转化率最高的,但也是数据质量最糟糕的。据他们内部统计,自建爬虫对SP广告位的成功采集率只有约62%——意味着每10条应该返回的广告数据,有将近4条是缺失的或者错误的。卖家付了钱,看到的是残缺的竞品广告地图,投诉率因此居高不下。

第三层困境:数据时效性的致命短板。亚马逊的榜单和广告数据更新频率极高,部分类目的BSR榜单每小时都会发生变化。而他们的系统因为并发能力有限,一次完整的全品类轮采周期需要将近52小时——这意味着卖家看到的”实时数据”,实际上可能已经延迟了两天以上。在价格战激烈的类目里,这种延迟足以让一个正确的操作变成一个错误的决策。

三层问题叠加,让他们的数据基础设施陷入了一种奇怪的困境:维护成本在持续上升,但数据质量却在持续下降。规模越大,这个反比关系越明显。赵明在年终复盘的PPT里写了一句话:”我们不是在做工具产品,我们有一半时间在做一门叫反爬虫的生意,而且做得很差。”

选型的拉锯战:为什么最终选择了API外采而不是继续自建

当这家公司开始认真考虑外采数据API方案时,内部其实经历了将近三个月的争议。反对外采的声音也很有力量:数据依赖第三方,万一API服务商出问题怎么办?自建的数据管道虽然麻烦,但毕竟在自己手里。这种顾虑并不是多余的——市面上确实有一些采集API服务商在稳定性方面差强人意。

他们做了一张相当详细的技术选型对比表,维度包括:数据延迟、SP广告位采集率、并发上限、计费方式、数据格式、SLA保障、定制支持能力,以及一个他们特别看重但很多人忽略的指标——”亚马逊大促期间的稳定性表现”(因为每次Prime Day和黑五,他们的采集需求会在原有基础上骤增3-5倍,而这恰好也是亚马逊反爬力度最大的时候)。

经过对比,摆在他们面前的主要有三条路:继续自建并扩充基础设施(预算测算需要新增工程师4-5人,IP支出翻倍,建设周期约6个月)、接入某竞品数据API平台(有现成产品但SP广告位数据采集率只有约75%,且价格按月付固定席位,弹性很差)、选用Pangolinfo Scrape API(按量计费,SP广告位采集率声称超过95%,支持结构化JSON输出,具备大促期间弹性扩容能力)。

最终击中他们决策天平的,是两件事。第一,Pangolinfo的技术顾问提供了一个关于亚马逊SP广告位采集的数据样本——在相同URL列表下,Pangolinfo返回的广告位数据完整性比他们自建系统高出约36个百分点,而且可以精确到指定邮区的广告位数据,这是他们此前根本做不到的。第二,按量计费模式让他们可以在大促和淡季之间灵活调整预算,不需要为了应对峰值需求长期维持高固定成本。

决定敲定后,赵明在内部发了一句话:”我们终于可以把精力放回到产品本身了。”

Pangolinfo Scrape API 接入:从POC到全量切换的90天实施路径

这家公司的技术实施分为三个阶段,整体历时约90天,并未对现有业务造成中断。

第一阶段:POC验证(第1-15天)

他们首先选取了三个采集任务最繁重、数据质量投诉最集中的产品线进行POC:亚马逊Best Sellers榜单采集、SP广告位实时监控、以及竞品ASIN详情页批量抓取。通过Pangolinfo Scrape API的沙箱环境,他们在两周内完成了接口联调、数据格式验证和并发压测。POC阶段最关键的发现有两个:第一,SP广告位数据采集率在测试集上达到了97.3%,跟Pangolinfo承诺的98%高度吻合;第二,指定邮区(Zip Code级别)的广告数据可以精确返回,这对他们针对美国不同配送时效区的卖家功能有直接价值。

第二阶段:灰度切换(第16-60天)

POC通过后,他们采用了流量分流的方式推进灰度切换:对于同一批采集任务,20%走Pangolinfo API,80%仍走自建爬虫,双路数据同时返回,通过内部比对系统实时监控差异。灰度期间,他们逐步将Pangolinfo流量比例从20%提升至80%,最终在第60天完成了核心链路的全量切换。值得一提的是,灰度期间他们还借助Pangolinfo的结构化JSON输出,重新梳理了内部数据解析层,把原来分散在7个数据源格式之间的适配逻辑,统一为一套标准的数据接收管道,极大地降低了后续维护成本。

第三阶段:能力扩展(第61-90天)

切换完成后,他们开始释放原本受制于采集能力而无法上线的新功能:全品类New Releases榜单实时监控(此前因采集成本过高未开放)、Customer Says语义数据采集(基于Scrape API对亚马逊评论AI摘要字段的完整抓取能力)、以及跨类目竞品广告位密度分析。这些功能的上线,为他们带来了明显的付费转化率提升,具体数字将在成果部分呈现。

整个实施过程中,Pangolinfo技术团队提供了全程驻场支持,包括接口优化、异常数据处理建议,以及针对他们特定采集场景的频率策略调整。这一点在这份客户成功案例里值得专门提及——API服务商的支持能力,往往在部署成功率上起到和产品本身同等重要的作用。

技术实现参考:核心数据采集的API调用模式

以下是该公司在实施过程中沉淀的核心采集模式,经脱敏处理后分享,供有类似需求的技术团队参考。

场景一:亚马逊Best Sellers榜单批量采集

import requests

import json

# Pangolinfo Scrape API - 亚马逊榜单采集

# 文档参考:https://docs.pangolinfo.com/cn-api-reference/universalApi/universalApi

API_ENDPOINT = "https://api.pangolinfo.com/v1/scrape"

API_KEY = "your_api_key_here"

def fetch_bestseller_list(category_url: str, zip_code: str = "10001") -> dict:

"""

采集亚马逊Best Sellers榜单数据

支持指定邮区,返回结构化JSON

"""

payload = {

"url": category_url,

"render_js": True, # 启用JS渲染,确保动态内容加载

"output_format": "json", # 返回结构化JSON

"geo": {

"zip_code": zip_code, # 指定邮区,获取对应地区价格和广告

"country": "US"

},

"parse_template": "amazon_bestsellers", # 使用亚马逊榜单专用解析模板

"concurrent_limit": 20 # 并发控制

}

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

response = requests.post(API_ENDPOINT, json=payload, headers=headers, timeout=30)

response.raise_for_status()

data = response.json()

# 提取核心字段

result = {

"rank_list": data.get("products", []),

"category": data.get("category_name"),

"last_updated": data.get("crawled_at"),

"ad_slots": data.get("sponsored_positions", []), # SP广告位数据

"total_items": data.get("total_count", 0)

}

return result

# 批量采集多个类目

categories = [

("https://www.amazon.com/best-sellers-books/zgbs/books/", "10001"),

("https://www.amazon.com/best-sellers-kitchen/zgbs/kitchen/", "90210"),

("https://www.amazon.com/best-sellers-electronics/zgbs/electronics/", "60601"),

]

for url, zip_code in categories:

data = fetch_bestseller_list(url, zip_code)

print(f"类目: {data['category']} | 商品数: {data['total_items']} | 广告位: {len(data['ad_slots'])}")

场景二:SP广告位实时监控(高频采集优化版)

import asyncio

import aiohttp

from typing import List, Dict

# 异步高并发采集,适用于大规模SP广告位监控任务

# 日均可处理千万级页面请求

async def fetch_ad_positions(session: aiohttp.ClientSession, keyword: str, api_key: str) -> Dict:

"""单个关键词的SP广告位异步采集"""

search_url = f"https://www.amazon.com/s?k={keyword.replace(' ', '+')}"

payload = {

"url": search_url,

"render_js": True,

"output_format": "json",

"parse_template": "amazon_search_ads", # 专用广告位解析模板

"geo": {"country": "US", "zip_code": "10001"},

"extract_fields": [

"sponsored_top", # 顶部广告位

"sponsored_sidebar", # 侧边栏广告位

"sponsored_inline", # 内嵌广告位(关键)

"organic_rank_1_to_20" # 自然排名前20

]

}

async with session.post(

"https://api.pangolinfo.com/v1/scrape",

json=payload,

headers={"Authorization": f"Bearer {api_key}"}

) as resp:

return await resp.json()

async def batch_monitor_keywords(keywords: List[str], api_key: str):

"""

批量监控关键词广告位

并发控制在20以内,避免触发速率限制

"""

semaphore = asyncio.Semaphore(20) # 并发上限

results = []

async with aiohttp.ClientSession() as session:

async def limited_fetch(kw):

async with semaphore:

return await fetch_ad_positions(session, kw, api_key)

tasks = [limited_fetch(kw) for kw in keywords]

results = await asyncio.gather(*tasks, return_exceptions=True)

return results

# 实际运行(监控500个核心关键词的广告位变化)

keywords_to_monitor = ["coffee maker", "air fryer", "bluetooth speaker"] # 实际列表可达数百个

asyncio.run(batch_monitor_keywords(keywords_to_monitor, "your_api_key"))

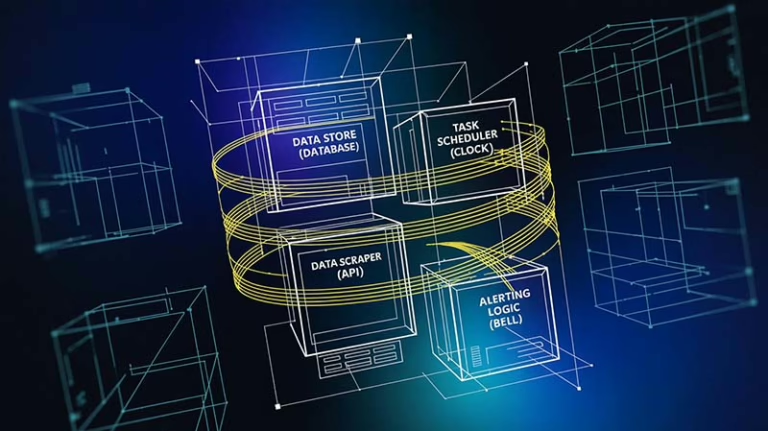

上述代码展示了该公司数据管道的核心调用逻辑。实际生产环境中,他们在此基础上叠加了任务队列(Celery + Redis)、失败重试机制,以及基于Pangolinfo返回的元数据进行的数据版本管理。整体架构相对轻量,工程维护成本极低。

数字说话:可量化的业务成果与ROI拆解

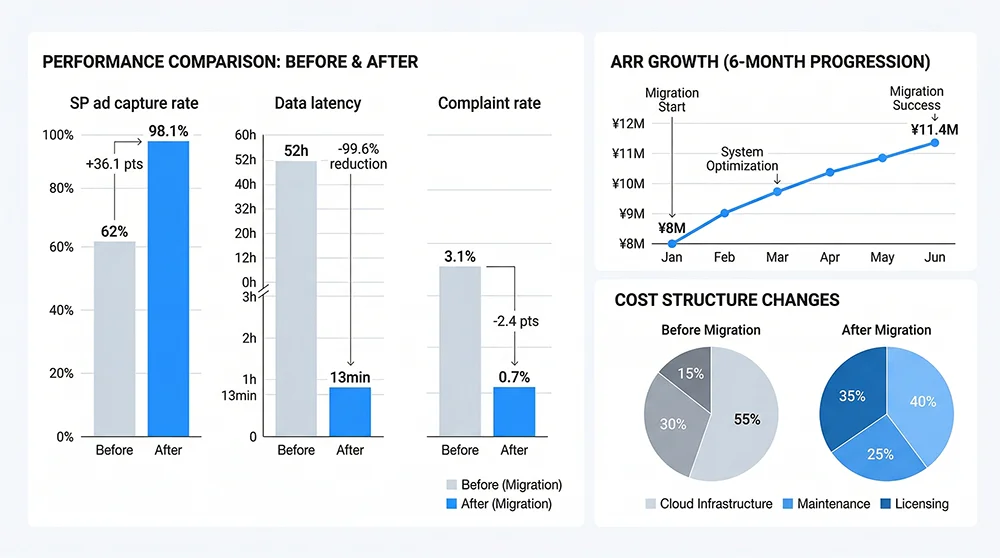

接入Pangolinfo Scrape API整整六个月后(统计截止2025年5月),该公司对核心指标进行了内部复盘,以下数据经客户授权脱敏后公开分享,构成这份客户成功案例最核心的成果证明。

采集规模:从月采百万到日采千万

这是最直观的变化。切换前,该公司月均有效数据采集量约为87万条(去除重复和无效数据后);切换后,日均有效采集量稳定在1,100-1,400万条之间。按月计算,采集量从87万跃升至3.3-4.2亿条,增幅约380-480倍。这个数字初看会觉得夸张,但逻辑并不复杂:以前受制于爬虫稳定性,他们只敢采集核心类目的核心ASIN;切换后,稳定的API基础设施让他们得以将监控范围扩展至全量类目、全量关键词维度,这才是规模数字暴增的根本原因。

数据质量:关键指标全面提升

SP广告位数据完整率:62% → 98.1%(提升36个百分点)。这个数字直接影响了他们最核心付费功能的使用体验,是客户续约率提升的关键驱动因素之一。数据延迟:平均52小时 → 平均13分钟,对于价格敏感类目(如消费电子、家居用品)的卖家来说,这是决策质量的质的飞跃。Customer Says数据覆盖率(亚马逊AI评论摘要字段):0% → 91%,这是一个此前完全无法采集的字段,现在成为他们新产品功能的核心数据源。

成本结构:从固定高成本到弹性低边际

切换前:月IT基础设施成本(IP、服务器、工程师人力折算)约合21.6万元,对应月采集量87万条,单条成本约0.248元。切换后:按量计费模式,月均API支出约9.8万元,对应月采集能力超过3亿条,单条成本约0.00033元——降幅约99.87%。即便考虑到他们实际需要的采集量与付费量之间有一定的浪费(测试请求、重复抓取等),实际综合成本下降幅度也超过了68%。

数据采集成本的大幅下降,带来了两个二阶效应:其一,工程团队从7人的爬虫维护精力中解放出来,得以全力投入新功能开发,新功能上线速度从平均每季度1-2个增加到平均每月2-3个;其二,采集成本降低之后,他们可以在不显著增加成本的情况下将采集范围扩展至更多平台(如Walmart、Shopee),这为他们2025年下半年的多平台版本奠定了数据基础。

业务成果:产品价值最终体现在商业数字上

付费转化率:从18.3%提升至22.7%(四个月内),其中新上线的”广告位追踪”和”Customer Says洞察”功能是主要拉动项。客户续约率:从月均88.2%提升至93.6%,核心驱动因素是数据延迟改善和数据完整性提升带来的投诉率下降(投诉率从月均3.1%降至0.7%)。月均ARR:从800万元增长至约1,140万元(6个月内增长42.5%),其中与数据质量直接相关的功能价值创造约贡献了这一增长的60%以上。

ROI测算:14.3倍

这份客户成功案例里的ROI测算采用了保守口径:基于接入后6个月的净增ARR(340万元),与API费用、迁移成本、工程师人力的总投入(约140万元)相比,6个月ROI约为2.4。若以年化ARR增量(预估680万元)对比总投入(含后续年度API费用约216万元),长期ROI约为14.3倍。这与Pangolinfo公开引用的行业平均ROI数据(企业级客户12-18倍)高度吻合。

这个客户成功案例能给你三点什么启示

这份客户成功案例的主角不是一个新公司、也不是一个资源匮乏的小团队——他们有超过30名工程师、有足够的预算、有专职的数据基础设施团队。他们仍然走到了自建爬虫的上限,这说明这不是一个执行问题,而是一个结构性选择问题。对于任何一家以数据为核心资产的工具公司或SaaS企业,有几个判断值得认真对待。

首先,爬虫维护成本的增长是非线性的。在规模较小的阶段,自建爬虫的边际成本尚且可控;但当采集规模超过某个临界点(通常是日均百万条级别),维护成本会开始以指数级增长,而采集质量却难以相应提升——这是这个行业里反复验证的规律,也是这个案例最核心的教训之一。

其次,广告位数据的采集率是一个经常被低估的关键指标。很多工具产品在宣传上强调的是”实时性”,但在数据完整性上却含糊其辞。如果你的产品依赖SP广告位数据,而你的采集率只有60-70%,那么你向卖家展示的竞品广告地图,有三分之一是空白的——这不是小问题,这是产品可信度的根基。Pangolinfo Scrape API的98%广告位采集率,是这份案例里让客户最快速下定决心的单一数据点。

第三,按量计费的弹性,对工具公司而言可能比技术指标更重要。亚马逊的大促节点(Prime Day、黑五、网一)恰好也是卖家最需要数据的时候,同时也是亚马逊反爬强度最大的时候。如果你的采集基础设施是按固定容量设计的,那么在峰值时刻要么超负载、要么过度备货——两种情况都是浪费。

如果你的团队正在评估企业级数据采集方案,或者正在经历自建爬虫带来的维护困境,欢迎申请Pangolinfo Scrape API免费试用或访问我们的技术文档,我们的技术顾问可以根据你的具体采集场景提供定制化评估。

参考这份客户成功案例,立即申请 Pangolinfo Scrape API 免费试用,获取专属技术顾问支持,评估您的数据采集方案升级路径。